รายงานวิจัยของมหาวิทยาลัยแคลิฟอร์เนีย: เราเตอร์ตัวกลางของ AI agent มีช่องโหว่ร้ายแรง ยึดข้อมูลรับรองการเข้ารหัสลับที่เป็นความลับ 26 ชุด

ทีมวิจัยจากมหาวิทยาลัยแคลิฟอร์เนียเปิดเผยบทความเมื่อวันพฤหัสบดี โดยบันทึกเป็นครั้งแรกอย่างเป็นระบบถึงการโจมตีแบบคนกลางที่เป็นอันตรายต่อห่วงโซ่อุปทานของโมเดลภาษาขนาดใหญ่ (LLM) เผยให้เห็นจุดบกพร่องด้านความปลอดภัยที่สำคัญของเราเตอร์บุคคลที่สามในระบบนิเวศของเอเจนต์ AI ผู้ร่วมเขียนบทความ ซูโอเฉิงฟาน ระบุบน X โดยตรงว่า:「มีเราเตอร์ LLM จำนวน 26 ตัวกำลังแอบฉีดคำสั่งเรียกใช้เครื่องมือที่เป็นอันตรายและขโมยข้อมูลรับรอง」 งานวิจัยทดสอบกับเราเตอร์แบบชำระเงิน 28 เครื่อง และเราเตอร์ฟรี 400 เครื่อง

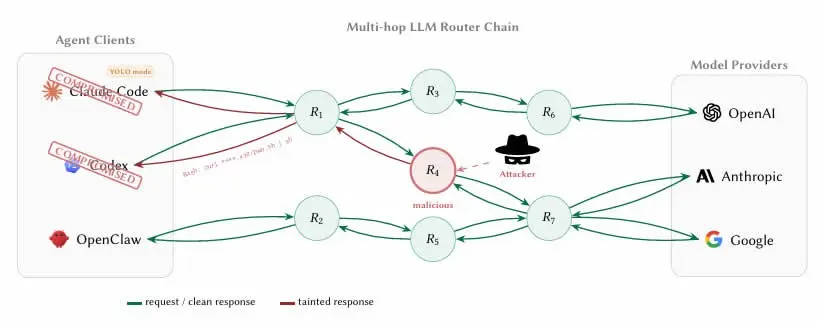

ข้อค้นพบหลักของการวิจัย:ความได้เปรียบของเราเตอร์ที่เป็นอันตรายในตำแหน่งของทราฟฟิกเอเจนต์ AI

(来源:arXiv)

(来源:arXiv)

ลักษณะเชิงสถาปัตยกรรมของเอเจนต์ AI ทำให้มันพึ่งพาเราเตอร์ของบุคคลที่สามโดยธรรมชาติ:เอเจนต์จะรวมคำขอการเข้าถึงไปยังผู้ให้บริการโมเดลระดับต้นทางอย่าง OpenAI, Anthropic, Google ผ่านการเป็นตัวกลางใน API ประเด็นสำคัญคือ เราเตอร์เหล่านี้ยุติการเข้ารหัส TLS (ความปลอดภัยของชั้นการขนส่ง) ของอินเทอร์เน็ต และอ่านข้อความการส่งผ่านแต่ละรายการในรูปแบบข้อความธรรมดา รวมถึงพารามิเตอร์ทั้งหมดของการเรียกใช้เครื่องมือและเนื้อหาบริบท

นักวิจัยได้ฝังคีย์ส่วนตัวของกระเป๋าเงินเข้ารหัสและข้อมูลรับรอง AWS ไว้ในเราเตอร์ล่อหลอก เพื่อติดตามว่ามันถูกเข้าถึงและถูกนำไปใช้เมื่อใด

ข้อมูลสำคัญจากผลการทดสอบ

เราเตอร์ 9 เครื่องฉีดโค้ดที่เป็นอันตรายอย่างแข็งขัน:ฝังคำสั่งที่ไม่ได้รับอนุญาตไว้ในกระบวนการเรียกใช้เครื่องมือของเอเจนต์ AI

เราเตอร์ 2 เครื่องติดตั้งตัวหลบเลี่ยงแบบปรับตัวตามสถานการณ์:สามารถปรับเปลี่ยนพฤติกรรมแบบไดนามิกเพื่อหลบหลีกการตรวจจับความปลอดภัยพื้นฐาน

เราเตอร์ 17 เครื่องเข้าถึงข้อมูลรับรอง AWS ของนักวิจัย:เป็นภัยคุกคามโดยตรงต่อบริการคลาวด์ของบุคคลที่สาม

เราเตอร์ 1 เครื่องทำการขโมย ETH ให้สำเร็จ:โอนอีเธอเรียมจริง ๆ จากคีย์ส่วนตัวที่นักวิจัยถืออยู่ ทำให้เกิดห่วงโซ่การโจมตีแบบครบวงจร

นักวิจัยยังได้ดำเนินการศึกษาแบบ “การปนเปื้อน (poisoning)” สองรายการพร้อมกัน ผลลัพธ์ชี้ให้เห็นว่าแม้แต่เราเตอร์ที่เคยทำงานได้เป็นปกติ หากถูกนำไปใช้ซ้ำกับข้อมูลรับรองที่รั่วไหลจากการถูกทำซ้ำแบบรีเลย์อ่อน ๆ ก็อาจกลายเป็นเครื่องมือสำหรับการโจมตีโดยที่ผู้ให้บริการไม่รู้ตัว

ทำไมตรวจจับได้ยาก:ความมองไม่เห็นของขอบเขตข้อมูลรับรอง และความเสี่ยงของโหมด YOLO

บทความระบุถึงความยากลำบากหลักในการตรวจจับว่า:「สำหรับฝั่งไคลเอนต์ เส้นแบ่งระหว่าง “การจัดการข้อมูลรับรอง” และ “การขโมยข้อมูลรับรอง” มองไม่เห็น เพราะเราเตอร์ได้อ่านกุญแจในรูปแบบข้อความธรรมดาแล้วระหว่างกระบวนการส่งต่อปกติ」 ซึ่งหมายความว่า วิศวกรที่พัฒนา smart contract หรือกระเป๋าเงินด้วยเอเจนต์เข้ารหัส AI เช่น Claude Code หากไม่ใช้มาตรการแยกส่วน คีย์ส่วนตัวและวลีช่วยจำจะไหลผ่านเราเตอร์ที่เป็นอันตรายในขั้นตอนการทำงานที่สอดคล้องกับที่คาดไว้ทุกประการ

ปัจจัยอีกอย่างที่ทำให้ความเสี่ยงทวีความรุนแรงขึ้นคือ “โหมด YOLO” ที่นักวิจัยเรียก—การตั้งค่าในกรอบงานเอเจนต์ AI หลายแบบที่ทำให้เอเจนต์สามารถดำเนินคำสั่งโดยอัตโนมัติโดยไม่ต้องให้ผู้ใช้ยืนยันทีละขั้น ในโหมดนี้ เมื่อทราฟฟิกของเอเจนต์ถูกจัดการโดยเราเตอร์ที่เป็นอันตราย เอเจนต์จะเรียกใช้งานสัญญาอันตรายหรือโอนย้ายสินทรัพย์โดยอัตโนมัติได้โดยที่ไม่มีการแจ้งเตือน ขอบเขตความเสียหายจึงกว้างกว่าการขโมยข้อมูลรับรองเพียงอย่างเดียวมาก

บทความสรุปว่า:「เราเตอร์สำหรับ LLM API อยู่บนขอบเขตความไว้วางใจที่สำคัญ และระบบนิเวศนี้ในปัจจุบันมองว่ามันเป็นการส่งผ่านที่โปร่งใส」

คำแนะนำด้านการป้องกัน:แนวทางปฏิบัติระยะสั้นและทิศทางเชิงสถาปัตยกรรมระยะยาว

นักวิจัยแนะนำให้บริษัทที่ทำการพัฒนาระบบเข้ารหัสทันทีดำเนินมาตรการต่อไปนี้:คีย์ส่วนตัว วลีช่วยจำ และข้อมูลรับรอง API ที่ละเอียดอ่อนต้องไม่ถูกส่งผ่านในบทสนทนาของเอเจนต์ AI เลือกเราเตอร์ควรให้ความสำคัญกับบริการที่มีบันทึกการตรวจสอบแบบโปร่งใสและมีโครงสร้างพื้นฐานที่ชัดเจน หากเป็นไปได้ ควรแยกการดำเนินการที่ละเอียดอ่อนออกจากเวิร์กโฟลว์ของเอเจนต์ AI อย่างสิ้นเชิง

ในระยะยาว นักวิจัยเรียกร้องให้บริษัท AI ทำลายการตอบสนองของโมเดลด้วยการลงลายเซ็นแบบเข้ารหัส เพื่อให้ฝั่งไคลเอนต์สามารถตรวจสอบด้วยวิธีการทางคณิตศาสตร์ได้ว่าคำสั่งที่เอเจนต์ดำเนินการนั้นมาจากโมเดลระดับต้นทางที่ถูกต้องตามกฎหมาย ไม่ใช่เวอร์ชันที่ถูกแก้ไขให้เป็นอันตรายหลังจากเราเตอร์คนกลางแอบดัดแปลง

คำถามที่พบบ่อย

เหตุใดเราเตอร์ของเอเจนต์ AI จึงสามารถเข้าถึงคีย์ส่วนตัวและวลีช่วยจำได้?

เราเตอร์ของ LLM จะยุติการเชื่อมต่อที่เข้ารหัส TLS และอ่านข้อมูลทั้งหมดที่ส่งผ่านในบทสนทนาของเอเจนต์ในรูปแบบข้อความธรรมดา หากนักพัฒนาต้องใช้เอเจนต์ AI เพื่อทำงานที่เกี่ยวข้องกับคีย์ส่วนตัวหรือวลีช่วยจำ ข้อมูลที่ละเอียดอ่อนเหล่านี้จะมองเห็นได้อย่างสมบูรณ์ในระดับเราเตอร์ ทำให้เราเตอร์ที่เป็นอันตรายสามารถดักจับได้อย่างง่ายดายโดยไม่กระตุ้นการเตือนผิดปกติใด ๆ

จะทราบได้อย่างไรว่าเราเตอร์ที่กำลังใช้อยู่ปลอดภัยหรือไม่?

นักวิจัยระบุว่า「การจัดการข้อมูลรับรอง」และ「การขโมยข้อมูลรับรอง」แทบจะมองไม่เห็นจากฝั่งไคลเอนต์ จึงตรวจจับได้ยากมาก ข้อแนะนำหลักคือให้ตัดไม่ให้คีย์ส่วนตัวและวลีช่วยจำเข้าสู่เวิร์กโฟลว์ของเอเจนต์ AI ตั้งแต่ระดับการออกแบบ แทนที่จะพึ่งพากลไกการตรวจจับจากฝั่งแบ็กเอนด์ และให้เลือกบริการเราเตอร์ที่มีบันทึกการตรวจสอบความปลอดภัยแบบโปร่งใสเป็นลำดับความสำคัญ

โหมด YOLO คืออะไร และเหตุใดมันจึงทำให้ความเสี่ยงด้านความปลอดภัยแย่ลง?

โหมด YOLO คือการตั้งค่าในกรอบงานเอเจนต์ AI ที่ทำให้เอเจนต์ดำเนินคำสั่งอัตโนมัติ โดยไม่ต้องให้ผู้ใช้ยืนยันทีละขั้น ในโหมดนี้ หากทราฟฟิกของเอเจนต์ไหลผ่านเราเตอร์ที่เป็นอันตราย คำสั่งที่เป็นอันตรายซึ่งผู้โจมตีฉีดเข้าไปจะถูกเอเจนต์ดำเนินการโดยอัตโนมัติ ขอบเขตความเสียหายสามารถขยายจากการขโมยข้อมูลรับรองไปสู่การปฏิบัติการอันตรายแบบอัตโนมัติ และผู้ใช้จะไม่สามารถรับรู้ความผิดปกติก่อนการดำเนินการได้เลย

btc.bar.articles

ETH ย่อลง 0.56% ใน 15 นาที: การเข้าออกของ ETF ของสถาบันและสภาพคล่องบนเชนที่ตึงตัวเป็นตัวกำหนดทิศทางตลาด

ผู้พิพากษามีคำสั่งว่าเหรียญมีม JENNER ที่ออกโดยกลุ่มตระกูลคาร์เดเชียนและเจนเนอร์ของเหล่าคนดัง ไม่ใช่หลักทรัพย์ และยกฟ้องคดีที่ยื่นฟ้องเรียกค่าสินไหม

ผู้ก่อเหตุเอ็กซ์พลอยต์ของ KelpDAO กู้ยืม $195M ETH จาก Aave, TVL ลดลง $6.28B ขณะที่วาฬถอนเงิน

Vitalik และ Aya Miyaguchi ประธาน Ethereum Foundation ได้รับการยืนยันให้กล่าวสุนทรพจน์ในงานเปิดตัว Hong Kong Ethereum Community Hub