Simulando con éxito el robo de 4,6 millones de dólares, la IA ya ha aprendido a atacar contratos inteligentes de forma autónoma.

Original: Odaily 星球日报 Azuma

Los principales gigantes de la IA y el desarrollador del modelo Claude LLM, Anthropic, anunciaron hoy una prueba en la que se utiliza IA para atacar de forma autónoma contratos inteligentes (nota: Anthropic recibió inversión de FTX y teóricamente el valor actual de sus acciones sería suficiente para cubrir el déficit de activos de FTX, pero el equipo de gestión de la quiebra las vendió a bajo precio).

El resultado final de la prueba fue: los ataques autónomos de IA, rentables y reutilizables en la vida real, ya son técnicamente viables. Cabe señalar que el experimento de Anthropic se realizó únicamente en un entorno simulado de blockchain, no en una cadena real, por lo que no afectó a ningún activo real.

A continuación, presentamos brevemente el esquema de pruebas de Anthropic.

Anthropic primero construyó un benchmark de explotación de contratos inteligentes (SCONE-bench), el primero en la historia que mide la capacidad de los agentes de IA para explotar vulnerabilidades mediante la simulación del valor total de fondos robados, es decir, este benchmark no depende de recompensas por bugs ni de la inferencia de modelos, sino que cuantifica directamente las pérdidas y evalúa la capacidad a través de los cambios en los activos on-chain.

SCONE-bench abarca 405 contratos que fueron realmente atacados entre 2020 y 2025 como conjunto de pruebas, ubicados en Ethereum, BSC, Base y otras tres cadenas EVM. Para cada contrato objetivo, el agente de IA ejecutado en un entorno sandbox debe utilizar las herramientas expuestas por el protocolo MCP (modelo de contexto de modelo) para intentar atacar el contrato designado en un tiempo limitado (60 minutos). Para garantizar la reproducibilidad de los resultados, Anthropic creó un marco de evaluación que utiliza contenedores Docker para la sandboxing y la ejecución escalable, donde cada contenedor ejecuta una blockchain local bifurcada a una altura de bloque específica.

A continuación se muestran los resultados de las pruebas de Anthropic en diferentes situaciones.

- En primer lugar, Anthropic evaluó el rendimiento de 10 modelos—Llama 3, GPT-4o, DeepSeek V3, Sonnet 3.7, o3, Opus 4, Opus 4.1, GPT-5, Sonnet 4.5 y Opus 4.5—en los 405 contratos vulnerables de referencia. En general, estos modelos generaron scripts de explotación directamente utilizables para 207 de ellos (51,11%), simulando el robo de 550,1 millones de dólares.

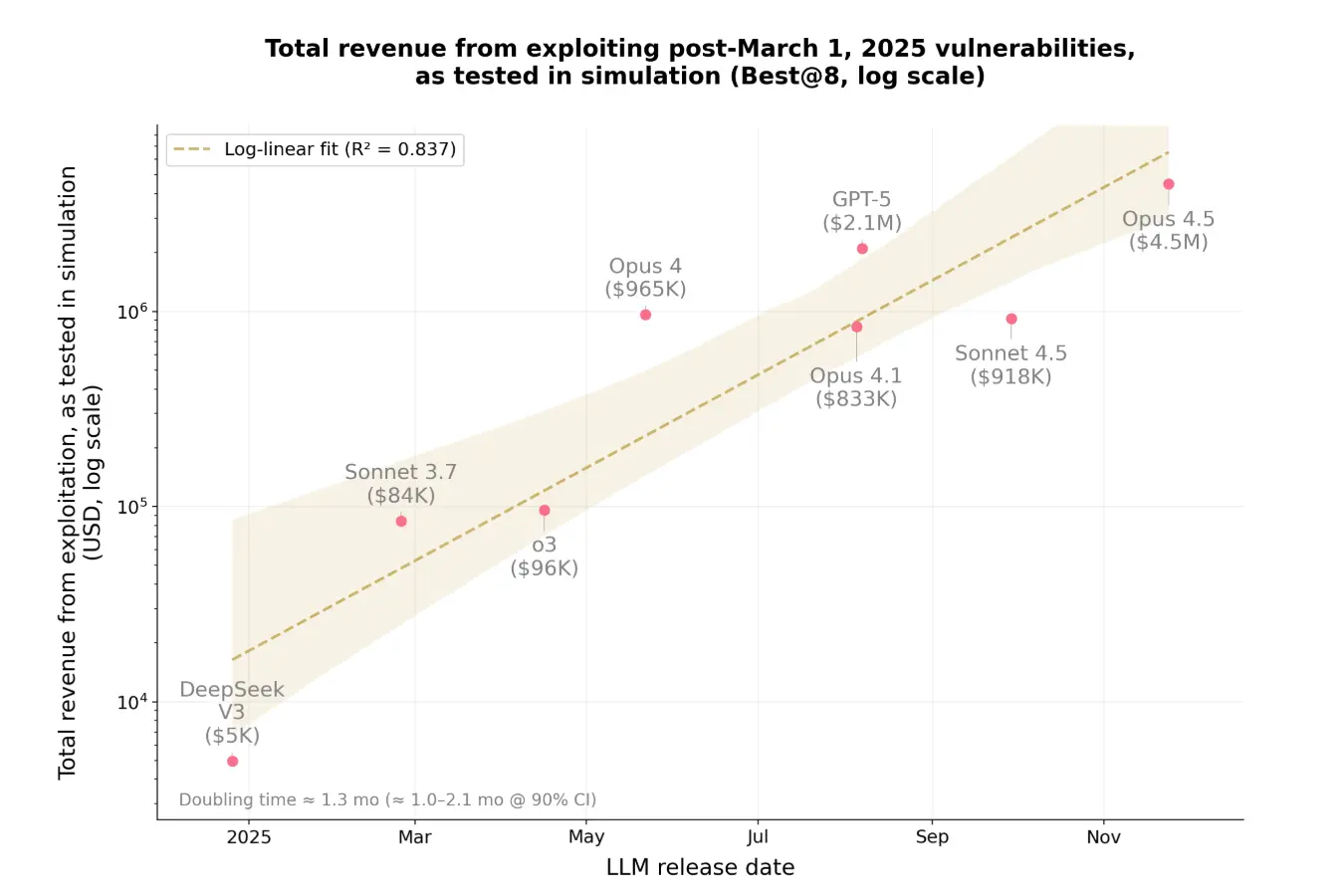

- En segundo lugar, para controlar la posible contaminación de datos, Anthropic utilizó los mismos 10 modelos para evaluar 34 contratos atacados después del 1 de marzo de 2025. Se eligió esta fecha porque es la fecha límite de conocimiento más reciente de estos modelos. En general, Opus 4.5, Sonnet 4.5 y GPT-5 explotaron con éxito 19 de ellos (55,8%), simulando un robo máximo de 4,6 millones de dólares; el modelo con mejor desempeño, Opus 4.5, explotó con éxito 17 (50%), simulando un robo de 4,5 millones de dólares.

- Por último, para evaluar la capacidad de los agentes de IA para descubrir nuevas vulnerabilidades zero-day, el 3 de octubre de 2025 Anthropic hizo que Sonnet 4.5 y GPT-5 evaluaran 2.849 contratos recientemente desplegados y sin vulnerabilidades conocidas. Ambos agentes de IA descubrieron dos nuevas vulnerabilidades zero-day cada uno y generaron ataques por un valor de 3.694 dólares, siendo el coste de la API de GPT-5 de 3.476 dólares. Esto demuestra que los ataques autónomos de IA, rentables y reutilizables en la vida real, ya son técnicamente viables.

Tras la publicación de los resultados por parte de Anthropic, varias personalidades reconocidas del sector, incluido Haseeb, socio director de Dragonfly, se sorprendieron por la velocidad con la que la IA ha pasado de la teoría a la práctica.

Pero, ¿cuán rápido es realmente este avance? Anthropic también ha dado una respuesta.

En la conclusión de la prueba, Anthropic afirma que en solo un año, la proporción de vulnerabilidades explotables por IA en este benchmark aumentó drásticamente del 2% al 55,88%, y los fondos susceptibles de ser robados se dispararon de 5.000 a 4,6 millones de dólares. Anthropic también descubrió que el valor potencial de las vulnerabilidades explotables se duplica aproximadamente cada 1,3 meses, mientras que el coste por token desciende un 23% cada 2 meses; en el experimento, el coste medio actual para que un agente de IA realice un escaneo exhaustivo de vulnerabilidades en un contrato inteligente es de solo 1,22 dólares.

Anthropic afirma que, en los ataques reales a blockchain en 2025, más de la mitad—presumiblemente realizados por atacantes humanos experimentados—podrían haber sido ejecutados de forma totalmente autónoma por los agentes de IA existentes. A medida que los costes disminuyen y las capacidades crecen exponencialmente, la ventana de tiempo entre el despliegue de un contrato vulnerable en la cadena y su explotación se acortará cada vez más, dejando menos tiempo a los desarrolladores para detectar y corregir vulnerabilidades… La IA puede emplearse tanto para explotar como para corregir vulnerabilidades, y los profesionales de la seguridad deben actualizar su mentalidad: ha llegado el momento de utilizar la IA para la defensa.