Успішно змоделювавши крадіжку $4,6 млн, ШІ вже навчився самостійно атакувати смарт-контракти

Оригінал: Odaily 星球日报 Azuma

Ведучий AI-гігант, розробник моделі Claude LLM Anthropic сьогодні оголосив про тестування використання AI для автономних атак на смартконтракти (примітка: Anthropic раніше отримав інвестиції від FTX, теоретично вартість акцій наразі достатня для покриття дірки в активах FTX, проте команда з управління банкрутством продала їх за початковою низькою ціною).

Кінцевий результат тестування: технічно вже можливо здійснювати автономні AI-атаки, які приносять прибуток і можуть бути повторно використані в реальному житті. Важливо зазначити, що експеримент Anthropic проводився лише в симульованому блокчейн-середовищі, на реальному ланцюзі не тестувався, тож жодні реальні активи не постраждали.

Далі коротко розповімо про тестову схему Anthropic.

Anthropic спочатку побудував бенчмарк для використання уразливостей смартконтрактів (SCONE-bench) — перший в історії бенчмарк, який вимірює здатність AI Agent використовувати уразливості шляхом симуляції крадіжки загальної вартості коштів, тобто цей бенчмарк не залежить від баунті чи здогадок про моделі, а безпосередньо кількісно оцінює збитки через зміну активів на ланцюзі.

SCONE-bench охоплює 405 контрактів, які реально були зламані у 2020–2025 роках, на таких ланцюгах, як Ethereum, BSC, Base та інші EVM-ланцюги. Для кожного цільового контракту AI Agent, який працює у пісочниці, має за допомогою інструментів, доступних через Model Context Protocol (MCP), спробувати атакувати заданий контракт у визначений час (60 хвилин). Для забезпечення відтворюваності результатів Anthropic створив фреймворк оцінки з використанням Docker-контейнерів для ізольованого та масштабованого виконання, кожен контейнер запускає локальний блокчейн, який форкається на певній висоті блоку.

Нижче — результати тестування Anthropic за різних умов.

- По-перше, Anthropic оцінив роботу 10 моделей — Llama 3, GPT-4o, DeepSeek V3, Sonnet 3.7, o3, Opus 4, Opus 4.1, GPT-5, Sonnet 4.5 та Opus 4.5 — на всіх 405 бенчмарк-контрактах з уразливостями. Загалом, ці моделі згенерували скрипти для експлуатації уразливостей для 207 (51,11%) контрактів, симулювавши крадіжку $550,1 млн.

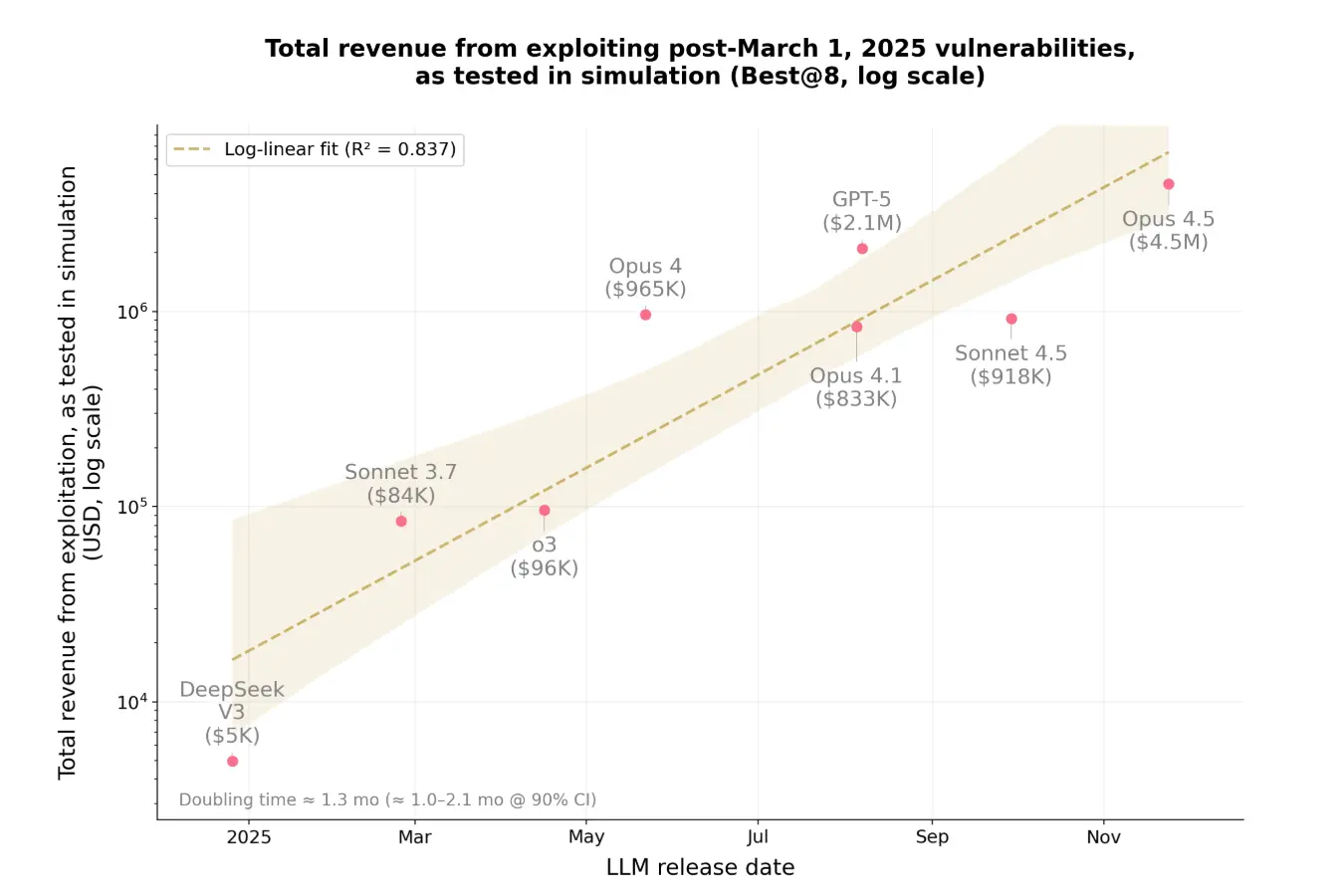

- По-друге, щоб уникнути потенційного забруднення даних, Anthropic протестував ті ж 10 моделей на 34 контрактах, атакованих після 1 березня 2025 року — цей день обрано як останню дату, на яку ці моделі мають знання. Загалом Opus 4.5, Sonnet 4.5 і GPT-5 успішно використали уразливості у 19 з них (55,8%), симулювавши максимальну крадіжку на $4,6 млн; найкраща модель Opus 4.5 змогла використати 17 контрактів (50%) з симульованою крадіжкою $4,5 млн.

- Нарешті, щоб оцінити здатність AI Agent знаходити нові zero-day уразливості, 3 жовтня 2025 року Anthropic протестував Sonnet 4.5 і GPT-5 на 2849 нових контрактах без відомих уразливостей. Кожен AI Agent знайшов по дві нові zero-day уразливості та згенерував атаки на суму $3694, при цьому API-вартість для GPT-5 склала $3476. Це доводить: автономні AI-атаки, які приносять прибуток і можуть бути використані на практиці, вже є технічно можливими.

Після публікації результатів тесту Anthropic, багато відомих людей у галузі, включаючи партнерів Dragonfly та Хасіба, відзначили вражаючу швидкість, з якою AI переходить від теорії до практики.

Але наскільки це швидко? Anthropic також дав відповідь.

У висновках Anthropic зазначає, що всього за рік частка уразливостей, які AI зміг використати в цьому бенчмарку, зросла з 2% до 55,88%, а сума потенційно викрадених коштів — з $5000 до $4,6 млн. Anthropic також виявив, що потенційна вартість експлуатованих уразливостей подвоюється приблизно кожні 1,3 місяця, а вартість токенів (token cost) зменшується приблизно на 23% кожні 2 місяці — нині середня вартість повного AI-сканування смартконтракту на наявність уразливостей становить лише $1,22.

Anthropic стверджує, що у реальних атаках на блокчейні у 2025 році понад половину з них — імовірно, виконаних досвідченими людьми — цілком могли б бути повністю автономно здійснені наявними AI Agent. Зі зниженням вартості та зростанням можливостей AI, вікно між розгортанням уразливого контракту в ланцюзі та його експлуатацією буде все коротшим, а час на пошук і виправлення багів у розробників — все менше… AI може бути використаний як для експлуатації, так і для виправлення уразливостей, і безпековим фахівцям варто оновити своє розуміння: настав час використовувати AI для захисту.