Anthropic lance les agents gérés Claude : l’infrastructure de base des agents IA commence à facturer 0,08 $/heure, réduisant fortement le temps de développement

Anthropic appose officiellement une étiquette de tarification sur l’infrastructure de base pour les AI Agents : 0,08 $ par heure d’exécution active ; Notion, Rakuten, Asana et Sentry font déjà partie des premiers clients.

(Contexte : Anthropic a repris l’architecture sous-jacente des AI Agents : Notion et Rakuten sont les premiers à être en ligne, la latence baisse jusqu’à 90 %)

(Informations complémentaires : les meilleurs modèles d’IA se spécialisent : ChatGPT vers C, Claude vers B)

Table des matières

Basculer

- Réduit de « quelques mois » à « quelques jours »

- La facture de 0,08 $

- La direction de la mise en service, et le premier repère de tarification du marché

8 centimes par heure, ça ne semble pas beaucoup. Mais si un AI agent exécute 8 heures par jour, et tourne à plein régime pendant 30 jours par mois, la facture s’élève à 19,2 $ US. Cela ne compte même pas les frais liés aux tokens. Ce matin (9), Anthropic a annoncé officiellement, en public beta, l’entrée de Claude Managed Agents dans des tests ouverts (public beta), et a publié le barème de tarification de son service d’AI agents hébergés.

Présentation de Claude Managed Agents : tout ce dont vous avez besoin pour construire et déployer des agents à grande échelle.

Il associe un agent harness optimisé pour les performances à une infrastructure de production, afin que vous puissiez passer du prototype au lancement en quelques jours.

Désormais en public beta sur la plateforme Claude. pic.twitter.com/vHYfiC1G56

— Claude (@claudeai) 8 avril 2026

De « quelques mois » à « quelques jours »

Le positionnement central de Claude Managed Agents n’est pas un modèle de langage plus performant, mais un ensemble d’API permettant aux entreprises de sauter la phase de construction de l’infrastructure. D’après Anthropic, traditionnellement, pour faire passer un prototype d’AI agent jusqu’à une mise en ligne officielle, il faut « quelques mois de travail d’infrastructure » : environnement de sandbox, authentification, pipeline d’exécution des outils, gestion d’état pour les exécutions de longue durée, et chaque élément nécessite que des ingénieurs le construisent depuis le début.

Avec Managed Agents, l’affirmation d’Anthropic est la suivante : tout cela, ils s’en chargent. Il ne reste aux entreprises qu’à définir ce que l’agent doit faire, puis à le déployer.

Anthropic a publié des données de performance après utilisation par plusieurs clients :

Sentry a apparié leur agent de débogage Seer avec un agent piloté par Claude ; ce dernier est chargé d’écrire les correctifs et d’ouvrir des PR, permettant aux développeurs d’accomplir en un seul flux le passage de la découverte d’un bug à l’obtention d’un correctif révisable.

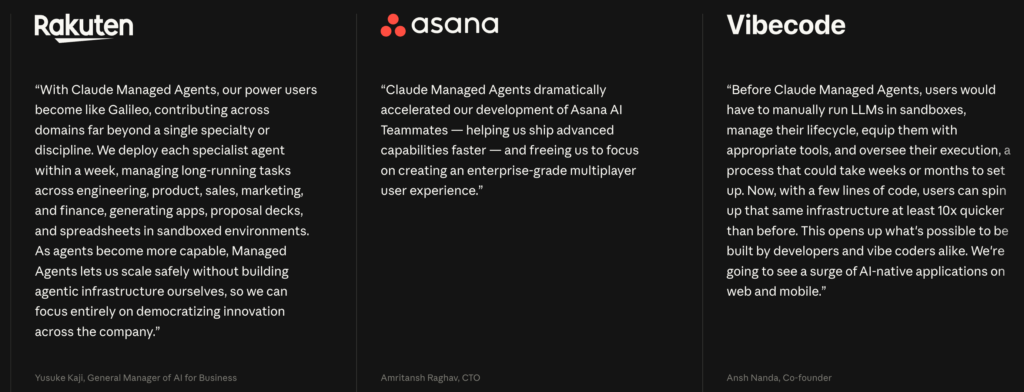

Les chiffres de Rakuten sont encore plus extrêmes : des agents d’entreprise couvrant les départements produits, ventes et marketing, ainsi que finance. Chaque équipe est déployée « en une semaine », en reliant Slack et Teams ; les employés peuvent confier des tâches à l’agent, et récupérer des livrables finis comme des tableurs, des présentations ou des applications.

Vibecode a mentionné qu’après l’intégration par défaut avec Managed Agents, ils aident les clients à passer d’un prompt à un app complète, en lançant avec la vitesse « au moins 10 fois » celle nécessaire pour une infrastructure équivalente.

On ne peut pas vérifier indépendamment la réalité de ces chiffres, mais la logique est cohérente : Anthropic vend du temps d’ingénierie. Le service managé absorbe la complexité ; le coût, c’est ce fameux $0.08/session-hour.

La facture de 0,08 $

La structure de tarification comporte deux niveaux : les frais de tokens du standard Claude Platform (facturés selon l’usage), puis le surcoût de 0,08 $ pour le temps d’exécution.

Si un agent unique exécute 8 heures par jour ouvré, le coût mensuel est d’environ 14 $, et, une fois ajoutés les frais de tokens, la facture réelle dépend du type de tâche. Mais pour les déploiements au niveau entreprise, c’est le nombre d’agents qui constitue le multiplicateur clé. Si Rakuten fait tourner plusieurs agents dans quatre départements, l’impact du nombre de sessions exécutées sur la facture mensuelle est alors très direct.

Les tests internes d’Anthropic montrent qu’avec des tâches de génération de fichiers structurés, le taux de réussite des tâches avec Managed Agents est « au plus » supérieur de 10 points de pourcentage par rapport à la boucle de prompting standard, et que l’amélioration est la plus visible sur les problèmes les plus difficiles. Toutefois, cela correspond au meilleur scénario, pas à la moyenne, et la difficulté des tâches de base n’est pas rendue publique.

D’après la logique d’achat côté client, la raison d’adopter la solution ne peut probablement pas être ces 10 points de pourcentage. Le plus crucial, c’est la compression du cycle de développement. Asana a mis en place, dans des projets, des « AI Teammates » pour la collaboration avec les humains, qui prennent des tâches en charge et rédigent des livrables ; l’entreprise indique que l’utilisation de Managed Agents accélère fortement le développement des fonctionnalités avancées.

Notion permet aux utilisateurs de déléguer directement le travail à Claude dans le workspace ; des dizaines de tâches peuvent être exécutées en parallèle (actuellement toujours en private alpha).

Pour les équipes produit de ces deux sociétés, ne pas avoir à construire de la gestion de sessions et de la coordination multi-agents de leur côté signifie que les ingénieurs peuvent consacrer leur temps à la différenciation produit, plutôt qu’à la maintenance de l’infrastructure.

Le point clé de compromis se situe à l’échelle. Pour un usage faible, le coût de la construction en interne est plus élevé ; pour des déploiements à grande échelle, l’effet cumulatif des 0,08 $ est ce qui sera reconsidéré.

La direction de la mise en service, et le premier repère de tarification du marché

En regardant plus largement, la sortie de Claude Managed Agents est un signal concret du virage du marché des AI Agents vers une logique « SaaS ».

Au cours des deux dernières années, la voie principale pour construire des AI agents en entreprise a été : choisir une API de modèle, construire une couche d’orchestration soi-même, gérer soi-même l’environnement d’exécution des outils, et gérer soi-même l’état d’exécution sur de longues périodes.

La démarche d’Anthropic consiste à absorber cette complexité et à l’intégrer dans la partie mensuelle. Ce n’est pas une idée nouvelle : AWS, Azure et GCP le font depuis une dizaine d’années. Mais au niveau des AI Agents, le 0,08 $/session-hour constitue l’un des premiers repères de tarification du marché actuellement visibles, publics et transparents.

La coordination multi-agents (Multi-agent coordination) est encore à l’étape research preview : il faut une demande pour l’utiliser. Cela signifie que les scénarios de tâches les plus complexes — où les agents peuvent démarrer et diriger d’autres agents pour traiter le travail en parallèle — ne sont pas encore complètement ouverts.

C’est aussi la variable la plus intéressante à observer pour l’évolution future de la tarification : quand les agents pourront se multiplier automatiquement en créant davantage d’agents, comment ajustera-t-on l’unité de facturation de 0,08 $ ?

Anthropic n’a pas répondu à cette question. Mais l’existence de la version en tests ouverts signifie qu’ils sont prêts à laisser le marché démarrer d’abord, pour que les chiffres parlent.