Claude ist was? Kosten, Funktionen, Claude Code, Cowork und vollständige Analyse der Unterschiede zu ChatGPT — 2026 Anthropic der ausführlichste Leitfaden

本文 umfassend die Funktionen, Preispläne, Modellwahl, Claude Code, Cowork und das MCP-Ökosystem von Claude, von der Nutzung der Werkzeuge bis hin zur Geschichte hinter Anthropic, geschrieben für jeden, der Claude verstehen möchte.

(Vorherige Ereignisse: Der Richter unterstützt Anthropic und verbietet dem US-Verteidigungsministerium, Claude mit einem „Lieferkettenrisikohinweis“ zu bestrafen)

(Hintergrundinformation: Anthropic AI Wirtschaftsinformationsbericht: Die Häufigkeit automatisierter Handels-Workflows hat sich verdoppelt, Claude wird von einem Werkzeug zu einem Lebensassistenten)

本文目錄

Toggle

- Anthropic Bewertung

- Von Claude 1 zu Opus 4.6: Eine Geschichte der Evolution von AI

- Ist die kostenlose Version ausreichend? Vollständige Analyse der Kosten von Claude

- Verbraucherpläne

- Unternehmenspläne

- API-Abrechnung

- Nicht nur Chatten: Vollständige Anleitung zu den Kernfunktionen von Claude

- Funktion 1: Projects (Projekte)

- Funktion 2: Artifacts (Erzeugnisse)

- Funktion 3: Memory (Erinnerung)

- Funktion 4: Extended Thinking (Erweitertes Denken)

- Claude Code: Das Terminalwerkzeug, das Ingenieure süchtig macht

- Claude Cowork: Der AI-Agent für Nicht-Programmierer

- MCP: Der USB-C der AI-Welt

- Bausteine für Entwickler: Claude API

- Claude vs ChatGPT vs Gemini: Wen sollte man wählen

- Wer ist Anthropic: Das Imperium der Aussteiger im Wert von 380 Milliarden Dollar

- Constitutional AI: Geben Sie der AI eine Verfassung

- Finanzierung und Zahlen

- Sicherheit ist kein Hindernis, sondern eine Verteidigungslinie

- 。2026/3/27

- 。2026/3/26

- 。2026/3/24

- 。2026/3/22

- 。2026/3/20

Was ist Claude? Warum wird in letzter Zeit gesagt, dass es ChatGPT übertrifft? Vielleicht haben Sie in sozialen Medien gesehen, wie jemand damit programmiert, forscht oder Berichte erstellt, sind sich aber nicht sicher, was die Unterschiede zu ChatGPT sind oder ob Sie Geld für ein Abonnement ausgeben sollten. Dieser Artikel soll diese Fragen klären. (Sie können je nach Bedarf zu den entsprechenden Abschnitten springen)

Zunächst eine kurze Definition: Claude ist ein AI-Assistent, der von Anthropic entwickelt wurde, mit vier Nutzungsmöglichkeiten: Webversion, Desktop-App, Terminalwerkzeug und API. Er kann Gespräche führen, Artikel schreiben, Code schreiben, Dokumente analysieren, im Internet suchen, Bilder verarbeiten und direkt auf Ihrem Computer mehrstufige Aufgaben ausführen.

Anthropic Bewertung

Bis März 2026 wird Claudes Muttergesellschaft Anthropic mit 380 Milliarden Dollar bewertet, mit einem jährlichen Umsatz von über 14 Milliarden Dollar. Amazon, Google, Microsoft und Nvidia sind die Investoren. Allein das Produkt Claude Code (Entwickler-Terminalwerkzeug) hat einen jährlichen Umsatz von 2,5 Milliarden Dollar, und die Anzahl der kommerziellen Abonnements hat sich seit Jahresbeginn vervierfacht.

Dieser Artikel wird aus der praktischsten Perspektive betrachtet: Was kann es tun, wie viel kostet es, wie wählt man einen Plan, und wer eignet sich für die verschiedenen Produkte? Danach wird die Geschichte von Anthropic betrachtet, um zu erklären, warum Claude einen anderen Weg als andere AI-Tools eingeschlagen hat.

Von Claude 1 zu Opus 4.6: Eine Geschichte der Evolution von AI

Um Claudes Produktlinie zu verstehen, muss man zunächst das Namensschema von Anthropic verstehen.

Im März 2024 hat Anthropic beim Release von Claude 3 ein dreistufiges Benennungssystem festgelegt: Opus (das Mächtigste), Sonnet (das Ausgewogene), Haiku (das Schnellste). Diese drei Namen entsprechen jeweils drei literarischen Formen (Kunstwerk, Shakespeare-Sonett, Haiku) von komplex bis einfach.

Der Gedanke hinter dieser Benennung ist: Verschiedene Aufgaben erfordern unterschiedliche Intelligenzstufen. Man würde keinen Doktoranden bitten, das Wetter zu überprüfen, und keinen Praktikanten, einen rechtlichen Vertrag zu schreiben. Opus ist der Doktor, Sonnet der Manager, Haiku der Assistent.

Hier ist der vollständige Evolutionszeitstrahl von Claude:

| Zeit | Modell | Schlüssel Durchbruch |

|---|---|---|

| März 2023 | Claude 1 | Erste Version, nur für eingeladene Nutzer |

| Juli 2023 | Claude 2 | Erstmalige öffentliche Veröffentlichung, 100K Kontextfenster |

| November 2023 | Claude 2.1 | Kontextfenster verdoppelt auf 200K Tokens (ca. 500 Seiten Dokument) |

| März 2024 | Claude 3 (Opus / Sonnet / Haiku) | Dreistufiges Benennungssystem etabliert, Bildverständnis hinzugefügt |

| Juni 2024 | Claude 3.5 Sonnet | Leistung übertrifft die vorherige Generation, das stärkste Opus 3 |

| Oktober 2024 | Claude 3.5 Sonnet v2 + Haiku | Funktion „Computerbenutzung“ in der öffentlichen Testphase |

| Februar 2025 | Claude 3.7 Sonnet | Einführung von „Extended Thinking“, damit das Modell zuerst schlussfolgern und dann antworten kann |

| Mai 2025 | Claude Sonnet 4 + Opus 4 | Programmierfähigkeiten erheblich verbessert |

| Oktober 2025 | Haiku 4.5 | Schnellste Modellerneuerung |

| November 2025 | Opus 4.5 | Optimierung von Code und Arbeitsaufgaben |

| Februar 2026 | Opus 4.6 | 1 Million Token Kontext (Beta), Agent Teams |

| Februar 2026 | Sonnet 4.6 | Erstmals in der Codierungsbewertung übertrifft die vorherige Generation Opus |

Zwei bemerkenswerte Meilensteine.

Erstens, das 1 Million Token Kontextfenster. Opus 4.6 kann etwa 1 Million Tokens gleichzeitig verarbeiten, was dem entspricht, dass man 10-15 Bücher auf einmal liest. Das bedeutet, Sie können Claude den gesamten Codebestand, den gesamten rechtlichen Vertrag oder den Jahresbericht auf einmal zur Analyse übergeben.

Zweitens, Agent Teams. Opus 4.6 hat die Fähigkeit eingeführt, dass mehrere Claude-Agenten gleichzeitig zusammenarbeiten können. Einfach ausgedrückt, früher konnten Sie nur mit einem Claude chatten, jetzt können Sie eine Gruppe von Claude mit verschiedenen Aufgaben betrauen: einer für die Forschung, einer für das Schreiben, einer für das Korrekturlesen, und dann die Ergebnisse zusammenfassen.

Diese beiden Durchbrüche markieren, dass Claude sich von einem „Chat-Tool“ zu einem „Arbeitssystem“ weiterentwickelt.

Ist die kostenlose Version ausreichend? Vollständige Analyse der Kosten von Claude

Claudes Preismodell ist in Verbraucherpläne und Unternehmenspläne unterteilt, zusätzlich zur nutzungsabhängigen API-Abrechnung. Hier ist der vollständige Vergleich vom März 2026.

Verbraucherpläne

| Plan | Monatliche Gebühr | Verfügbare Modelle | Kernmerkmale |

|---|---|---|---|

| Free | $0 | Sonnet 4.5 | Grundlegende Gespräche, Bildanalyse, Websuche, Projects, Artifacts, Memory |

| Pro | $20/Monat (jährliche Zahlung $17/Monat) | Opus 4.6 + Sonnet 4.6 + Haiku 4.5 | Claude Code, Cowork, Research, alle Funktionen freigeschaltet (mit API-Nutzungsgrenze) |

| Max 5x | $100/Monat | Gleich wie Pro | 5-fache Nutzung des Pro API, Prioritätszugang |

| Max 20x | $200/Monat | Gleich wie Pro | 20-fache Nutzung des Pro API, höchste Priorität |

Claude Code (Terminal-Entwicklungswerkzeug) und Cowork (Desktop-Agent) sind API-abrechnungsbasierte Entwicklerwerkzeuge und stellen zwei unabhängige Systeme von der webbasierten Abonnementsystem dar.

Was kann die kostenlose Version? Ab Februar 2026 hat Anthropic alle Funktionen von Memory (Erinnerung), Projects (Projekte) und Artifacts (Erzeugnisse), die zuvor nur für zahlende Nutzer zugänglich waren, für kostenlose Nutzer freigegeben.

Sie können mit der kostenlosen Version Artikel schreiben, Bilder analysieren, Daten organisieren und im Web suchen. Die einzige Einschränkung ist, dass die Nutzung begrenzt ist (dynamisch angepasst basierend auf der Gesprächslänge und -häufigkeit), und dass nur Sonnet 4.5 verfügbar ist, nicht das stärkste Opus.

Lohnt sich Pro? 20 Dollar pro Monat (ca. 640 NT$) schaltet alle Modelle, Claude Code (Terminal-Entwicklungswerkzeug), Cowork (Desktop-Agent) und tiefgehende Forschungsfunktionen frei.

Für wen eignet sich Max? Wenn Sie ein intensiver Nutzer sind, der jeden Tag mehrere Stunden mit Claude Code programmiert oder umfangreiche Analysen mit Opus 4.6 durchführen muss, reicht das Pro-Limit möglicherweise nicht aus. Max 5x ($100/Monat) oder Max 20x ($200/Monat) bieten größere Nutzungskapazitäten und höchste Priorität.

Unternehmenspläne

| Plan | Monatliche Gebühr/Person | Merkmale |

|---|---|---|

| Team Standard | $25 (jährlich) / $30 (monatlich) | Teamzusammenarbeit, SSO, Management-Dashboard, ab 5 Personen |

| Team Premium | $150/Person/Monat | Enthält Claude Code, Vorabzugang zu neuen Funktionen |

| Enterprise | Preis auf Anfrage | Granulare Berechtigungen, SCIM, Audit-Protokolle, benutzerdefinierte Datenaufbewahrungspolitik |

API-Abrechnung

| Modell | Eingabekosten (pro Million Tokens) | Ausgabekosten (pro Million Tokens) |

|---|---|---|

| Haiku 4.5 | $1 | $5 |

| Sonnet 4.6 | $3 | $15 |

| Opus 4.6 | $5 | $25 |

Einfach gesagt, wenn Sie Entwickler sind und die API von Sonnet 4.6 für allgemeine Aufgaben verwenden (Eingabe 1.000 Tokens + Ausgabe 500 Tokens), kostet jede Interaktion etwa 0,01 Dollar, weniger als 1 NT$.

Nicht nur Chatten: Vollständige Anleitung zu den Kernfunktionen von Claude

Viele Menschen denken bei Claude immer noch, dass es nur ein weiteres ChatGPT ist. Doch die Reihe von Funktionen, die Claude zwischen 2025 und 2026 eingeführt hat, hat es bereits von einem Dialogwerkzeug zu einer Arbeitsplattform weiterentwickelt.

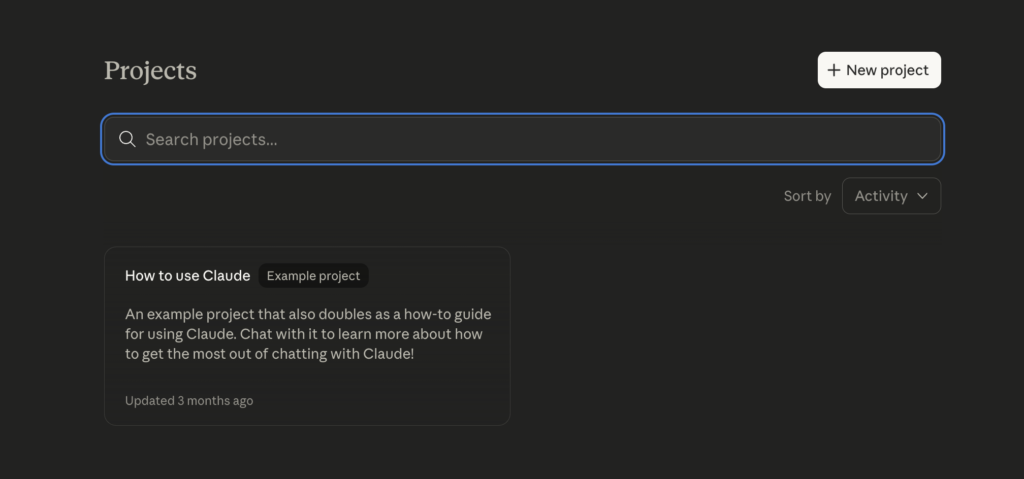

Funktion 1: Projects (Projekte)

Was ist das? Projects ermöglicht es Ihnen, einen eigenen Arbeitsbereich in Claude zu erstellen. Sie können Dateien (PDF, Code, Tabellen) hochladen, Hintergrundanweisungen schreiben und dann in diesem Arbeitsbereich mehrere Gespräche eröffnen. Alle Gespräche werden automatisch mit Ihren vordefinierten Dateien und Anweisungen geladen.

Warum ist das wichtig? Stellen Sie sich vor, Sie sind ein Analyst, der FinTech erforscht. Sie könnten ein „Fintech-Forschungsprojekt“ anlegen, 10 relevante Branchenberichte und Ihr Analyseframework hochladen und jedes Mal, wenn Sie ein neues Gespräch beginnen, „weiß“ Claude bereits, wer Sie sind und was Ihre Bedürfnisse sind. Sie müssen nicht jedes Mal alles neu erklären.

Wie benutzt man es?

- Klicken Sie in der linken Seitenleiste von Claude auf „Neues Projekt“.

- Benennen Sie das Projekt (zum Beispiel „Q1 Finanzberichterstattung“).

- Laden Sie relevante Dateien hoch (maximal 200K Tokens Wissensbasis).

- Schreiben Sie benutzerdefinierte Anweisungen (z. B. „Ich bin ein Finanzanalyst aus Taiwan, bitte antworten Sie auf Mandarin, Datenzitate müssen Quellen enthalten“).

- Öffnen Sie ein Gespräch im Projekt, alle Kontextdaten werden automatisch geladen.

Funktion 2: Artifacts (Erzeugnisse)

Was ist das? Wenn Sie Claude bitten, längere Inhalte zu generieren: Code, Artikel, Diagramme, Webseiten, wird das Ergebnis in einem separaten Panel neben dem Chatfenster angezeigt. Sie können es sofort anschauen, bearbeiten, kopieren oder sogar direkt herunterladen.

Warum ist das wichtig? Traditionelle AI-Chats packen alle Ausgaben in eine lange Reihe von Gesprächen, was es schwierig macht, einen bestimmten Codeabschnitt zu finden. Artifacts trennt „Produktion“ und „Gespräch“, sodass Sie sich auf die Ergebnisse konzentrieren können.

Was kann erstellt werden?

- Vollständige HTML/CSS/JavaScript-Webseiten (sofortige Vorschau möglich)

- React-Komponenten

- SVG-Diagramme und Infografiken

- Mermaid-Flussdiagramme

- Python-Skripte

- Markdown-Langtexte

- CSV-Tabellen

Praktischer Tipp: Sie können zu Artifacts sagen: „Ändere die Farbschema dieses Diagramms in ein dunkles Thema“ oder „Füge dieser Codezeile eine Fehlerbehandlung hinzu“, Claude wird die Änderungen direkt im Panel vornehmen, anstatt das gesamte Dokument neu zu generieren.

Funktion 3: Memory (Erinnerung)

Was ist das? Claude extrahiert automatisch wichtige Informationen aus den Gesprächen: Ihren Namen, Beruf, Vorlieben, Projekt Hintergrund, speichert sie und wendet sie in späteren Gesprächen automatisch an.

Warum ist das wichtig? Dies löst das größte Problem bei AI-Chats: Jedes Mal, wenn Sie ein neues Gespräch beginnen, müssen Sie von vorne anfangen. Mit der Memory-Funktion ist Claude wie ein echter Assistent: Er erinnert sich, wer Sie sind, was Sie tun und welche Art von Antworten Sie bevorzugen.

Seit Februar 2026 ist die Memory-Funktion für alle Nutzer (einschließlich kostenloser Nutzer) verfügbar, dies ist eine strategische Entscheidung von Anthropic, um den Übergang von ChatGPT zu erleichtern.

Wie verwaltet man das?

- Claude merkt sich automatisch wichtige Informationen, Sie müssen nichts manuell tun.

- Sie können klar sagen: „Erinnere dich, dass ich ein Software-Ingenieur aus Taiwan bin und es bevorzuge, TypeScript zu verwenden.“

- Auf der Einstellungsseite können Sie den Inhalt, den Claude sich gemerkt hat, einsehen, bearbeiten oder löschen.

- Sie können auch sagen: „Vergiss alles, was du über mich weißt“, um das Gedächtnis zu löschen.

Funktion 4: Extended Thinking (Erweitertes Denken)

Was ist das? Extended Thinking ermöglicht es Claude, vor der Beantwortung einen „Denken“-Prozess durchzuführen. Sie können sehen, wie Claude Schritt für Schritt zu einer Antwort gelangt.

Warum ist das wichtig? Für Fragen, die mehrstufiges Denken erfordern, wie Mathematik, logische Schlussfolgerungen oder Programmfehlerbehebung, kann Extended Thinking die Genauigkeit erheblich steigern.

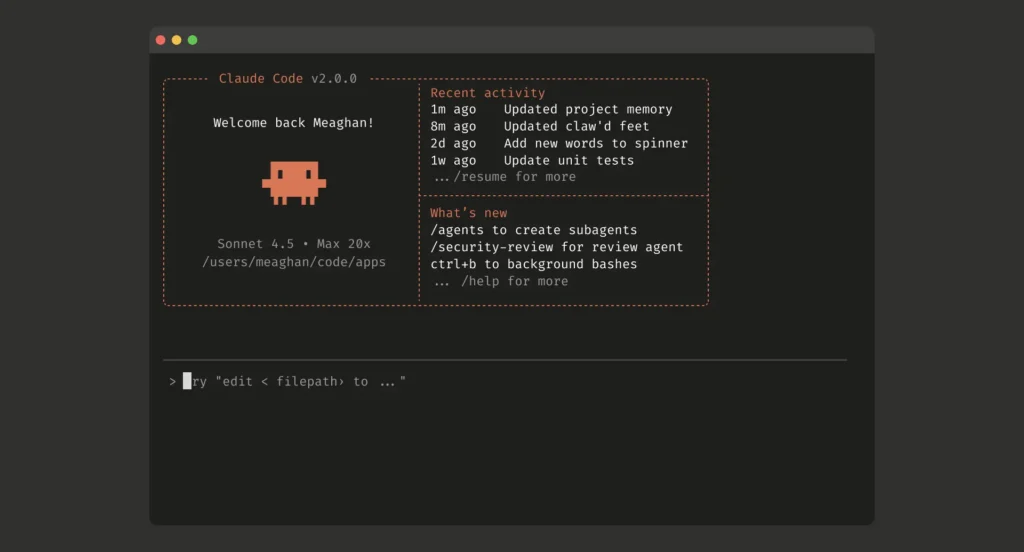

Claude Code: Das Terminalwerkzeug, das Ingenieure süchtig macht

Um ehrlich zu sein, die Verwendung von Claude im Web-Chat-Interface hat für den Durchschnittsnutzer nicht so viel Unterschied zu anderen Wettbewerbern, aber das speziell für Ingenieure entwickelte Claude Code ist sein neuester großer Durchbruch.

Was ist Claude Code? Es ist ein AI-Entwicklungswerkzeug, das direkt in Ihrem Terminal läuft. Sie müssen Ihren Code-Editor oder die Befehlszeile nicht verlassen, um Claude zu bitten, Code zu schreiben, Fehler zu beheben, umzugestalten, Tests zu schreiben oder Git-Operationen durchzuführen.

Einfach gesagt, Claude Code ist wie ein erfahrener Ingenieur, der in Ihrem Terminal sitzt. Sie beschreiben in natürlicher Sprache, was Sie tun möchten, und er geht direkt in Ihr Code-Repository und legt los.

Betriebsumgebungen:

- CLI (Befehlszeile): Geben Sie einfach claude im Terminal ein, um es zu starten.

- VS Code Erweiterung: Native Integration in VS Code, um direkt im Editor zu interagieren.

- JetBrains Plugin: Native Unterstützung für JetBrains IDEs wie IntelliJ, WebStorm usw.

- Desktop-Anwendung: Eigenständige Desktop-App.

- Web-Version: Verfügbar auf claude.ai/code.

Kernfähigkeiten:

- Mehrere Dateibearbeitung: Claude Code kann mehrere Dateien gleichzeitig ändern. Zum Beispiel, wenn Sie sagen: „Ändere die Fehlerbehandlung aller API-Endpunkte in ein einheitliches Format“, wird es das gesamte Projekt scannen, alle relevanten Dateien finden und nacheinander ändern.

- Befehlsausführung im Terminal: Es kann Shell-Befehle direkt ausführen, Tests durchführen, Pakete installieren und den Entwicklungsserver starten. Sie müssen nicht zwischen Claude und dem Terminal hin und her wechseln.

- Git-Operationen: Erstellen von Branches, Commit durchführen, Code pushen, Pull Requests erstellen, alles in natürlicher Sprache erledigt.

- Codeverständnis: Sie können fragen: „Was macht diese Funktion?“, „Warum schlägt dieser Test fehl?“, „Gibt es Sicherheitsanfälligkeiten in diesem Code?“, es wird die relevanten Dateien lesen, den Kontext analysieren und eine Erklärung geben.

- Agent Teams (Agenten-Teams): Eine neue Fähigkeit, die in Opus 4.6 eingeführt wurde, die es mehreren Claude-Agenten ermöglicht, parallel zu arbeiten. Sie können beispielsweise einen Agenten mit dem Schreiben einer Frontend-Komponente beauftragen, während ein anderer Agent eine Backend-API erstellt und ein dritter Agent Tests schreibt.

Praktische Szenarien:

Sie: „Migriere dieses Express.js-Projekt von JavaScript nach TypeScript“

Claude Code: [Liest alle .js-Dateien → Analysiert Abhängigkeiten → Installiert TypeScript → Erstellt tsconfig.json → Konvertiert die Dateien nacheinander → Behebt Typfehler → Führt Tests zur Bestätigung aus]

Sie: „Finde heraus, warum die CI-Pipeline fehlschlägt“

Claude Code: [Liest CI-Einstellungen → Überprüft Fehlermeldungen → Analysiert fehlgeschlagene Tests → Lokalisiert die Ursache → Schlägt Lösungen vor]

Kosten: Claude Code ist im Pro-Plan (20 $/Monat) und höher enthalten. Die kostenlose Version unterstützt es nicht. Team Premium (150 $/Person/Monat) enthält ebenfalls Claude Code.

Wenn Sie die API verwenden, werden die Kosten für Claude Code nach dem Verbrauch der API-Tokens berechnet.

Der jährliche Umsatz von Claude Code hat bereits 2,5 Milliarden Dollar erreicht, und die Anzahl der kommerziellen Abonnements hat sich seit Anfang 2026 vervierfacht. Viele Ingenieure berichten, dass sie, sobald sie Claude Code verwendet haben, früher oder später in den Max-Modus wechseln werden.

Claude Cowork: Der AI-Agent für Nicht-Programmierer

Was ist Cowork? Es ist das Desktop-AI-Agentensystem von Anthropic, das am 12. Januar 2026 eingeführt wurde. Es läuft nicht im Browser, sondern direkt auf Ihrem Computer, kann auf Ihre lokalen Dateien zugreifen, Anwendungen öffnen, im Web browsen, Formulare ausfüllen und mehrstufige Aufgaben von Anfang bis Ende erledigen.

Einfach gesagt, Cowork ist wie ein digitaler Assistent, den Sie eingestellt haben, der vor Ihrem Computer sitzt und Ihnen Aufgaben abnimmt.

Kernfähigkeiten:

- Zugriff auf lokale Dateien: Sie geben einen Ordner an, Cowork kann alle darin enthaltenen Dateien lesen, bearbeiten und organisieren, ohne manuelles Hochladen oder Herunterladen.

- Anwendungssteuerung: Cowork kann Anwendungen auf Ihrem Computer öffnen, den Browser steuern, Tabellen ausfüllen und direkt für Sie arbeiten.

- Aufgabenaufteilung in mehrere Schritte: Sie beschreiben eine komplexe Aufgabe, Cowork wird sie automatisch in kleinere Aufgaben aufteilen, parallel bearbeiten und die Ergebnisse zusammenfassen.

- Aufgaben planen: Geben Sie in einer beliebigen Cowork-Aufgabe /schedule ein, um eine automatisierte Aufgabe zu planen.

- Dispatch: Sie können über Ihr Handy oder Desktop weiterhin mit Claude kommunizieren und jederzeit Aufgaben zuweisen.

- Plugins: Plugins können Cowork spezielle Fähigkeiten, Verbindungen und Unteragenten hinzufügen, um sie an verschiedene Rollen und Teams anzupassen.

Praktische Szenarien:

- Forschungsbericht: „Organisiere die 20 PDFs in diesem Ordner zu einem zusammenfassenden Bericht.“

- Dateiverwaltung: „Klassifiziere die Dateien im Download-Ordner nach Typ, benenne sie um und organisiere sie in die entsprechenden Unterordner.“

- Dokumentenerstellung: „Erstelle einen Excel-Analysebericht mit Diagrammen basierend auf diesen Rohdaten.“

- E-Mail-Management: „Organisiere die wichtigen E-Mails der letzten Woche in meinem Posteingang und fasse die Aktionspunkte zusammen.“

Aktuelle Einschränkungen:

- Es ist noch eine Forschungs-Beta-Version, die Stabilität wird weiterhin verbessert.

- macOS und Windows werden beide unterstützt (Windows wurde am 10. Februar 2026 eingeführt).

- Pro-Plan oder höher erforderlich.

Cowork repräsentiert einen klaren Trend: AI entwickelt sich von einer Frage-Antwort-Interaktion zu „Du sagst, ich tue“. Die Chat-Oberfläche ist die erste Generation der AI-Interaktionsmuster, Agenten sind die zweite Generation.

MCP: Der USB-C der AI-Welt

Was ist MCP? Es ist ein offener Standard, den Anthropic im November 2024 eingeführt hat, der es AI-Anwendungen ermöglicht, sicher mit externen Systemen, Datenbanken, Cloud-Diensten, Entwicklungstools und Unternehmenssoftware zu verbinden.

Anthropic hat eine sehr präzise Metapher verwendet: MCP ist das USB-C der AI.

Vor der Einführung von MCP musste jedes AI-Tool, um einen externen Dienst zu verbinden, eine separate Integration entwickeln. Sie müssten eine Integration für Google Drive, eine für Slack, eine für GitHub schreiben. Wenn es 10 AI-Tools und 10 externe Dienste gibt, wären 100 Integrationen erforderlich.

MCP definiert eine Standard-Schnittstelle. Externe Dienste müssen nur einen MCP-Server erstellen, und jedes AI-Tool, das MCP unterstützt, kann sich verbinden. 10 AI-Tools und 10 externe Dienste benötigen nur 20 Integrationen.

Drei Kernkomponenten:

- Tools (Werkzeuge): Funktionen, die AI aufrufen kann (z. B. „Google Drive durchsuchen“, „GitHub-Issue erstellen“).

- Resources (Ressourcen): Daten, die AI lesen kann (z. B. Dateiinhalt, Datenbankabfrageergebnisse).

- Prompts (Eingabeaufforderungen): Vorgegebene Interaktionsvorlagen.

Derzeitiges Ökosystem:

- Offizielle Connectoren: Google Drive, Google Kalender, Gmail, Slack, GitHub, DocuSign, WordPress, FactSet usw.

- Community-Connectoren: PostgreSQL, Discord, Notion, MongoDB, Figma und Hunderte mehr.

- Unterstützte AI-Tools: Claude, ChatGPT, VS Code, Cursor, JetBrains IDE usw.

- Entwickler: Innerhalb von sechs Monaten nach Veröffentlichung haben über 10.000 Entwickler MCP implementiert.

Bausteine für Entwickler: Claude API

Wenn Sie Entwickler sind und Claudes Fähigkeiten in Ihre Anwendungen integrieren möchten, ist die API Ihr Zugangspunkt.

Grundlegende Anwendung: Senden Sie Anfragen über Anthropics Messages API, Claude gibt eine Antwort zurück. Unterstützt offizielle SDKs für Python und TypeScript.

from anthropic import Anthropic

client = Anthropic()

message = client.messages.create(

model="claude-sonnet-4-6-20260217",

max_tokens=1024,

messages=[

{"role": "user", "content": "Erkläre, was DeFi ist."}

]

)

print(message.content[0].text)

Erweiterte Funktionen:

- Tool Use (Werkzeugnutzung / Funktionsaufruf): Sie definieren eine Gruppe von Werkzeugen (Funktionen), und Claude entscheidet automatisch, wann es welches Werkzeug je nach Gespräch aufrufen soll. Wenn Sie zum Beispiel ein „Aktienpreis abfragen“-Werkzeug definieren, wird Claude es automatisch aufrufen, wenn der Nutzer fragt: „Wie viel kostet TSMC gerade?“, um die aktuellen Daten zu erhalten und die Antwort zu formulieren.

- Vision (Sicht): Die API unterstützt die Eingabe von Bildern und PDFs. Sie können Claude bitten, Screenshots zu analysieren, Dokumente zu lesen und Diagramme zu verstehen.

- Streaming (Streaming): Echtzeit-Ausgabe der Antwort, um das Benutzererlebnis zu verbessern.

- Prompt Caching (Eingabeaufforderungscaching): Wenn mehrere Ihrer Anforderungen die gleiche Systemaufforderung oder Hintergrunddateien teilen, kann das Caching bis zu 90% der Eingabe-Token-Kosten einsparen.

- Batch API (Batchverarbeitung): Eine große Anzahl von Anforderungen kann im Batch-Modus verarbeitet werden, die Kosten werden halbiert, was sich für Offline-Aufgaben eignet.

Best Practices (basierend auf den offiziellen Empfehlungen von Anthropic):

- Halten Sie die Anzahl der Werkzeuge auf 8 oder weniger, damit Claude präziser entscheiden kann, wann welches Werkzeug verwendet werden soll.

- Nehmen Sie sich Zeit, um die Beschreibungen der Werkzeuge gut zu verfassen; das ist effektiver, als die Anzahl der Werkzeuge zu erhöhen.

- Verwenden Sie Sonnet für allgemeine Aufgaben, Opus für komplexe Schlussfolgerungen, Haiku für schnelle Antworten.

Claude vs ChatGPT vs Gemini: Wen sollte man wählen

Das ist die Frage, die sich jeder stellt. Hier ist ein umfassender Vergleich basierend auf mehreren unabhängigen Bewertungen aus dem Jahr 2026. (Die Bedürfnisse können unterschiedlich sein, dies dient nur als Referenz)

| Dimension | Claude | ChatGPT | Gemini |

|---|---|---|---|

| Komplexe Schlussfolgerungen | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Programmieren | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Qualität des natürlichen Textes | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Antwortgeschwindigkeit | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Kontextlänge | 200K (Opus 4.6 Version 1M) | 128K | 1M |

| Sicherheit | Constitutional AI | RLHF | Google Sicherheitsrahmen |

| Monatliche Gebühr | Ab $20 | Ab $20 | Ab $19,99 |

Die ehrlichste Empfehlung: Alle drei Tools haben ihre Stärken, eine clevere Strategie ist es, ein anderes Modell auszuprobieren, wenn Sie mit der Qualität eines Modells nicht zufrieden sind.

Wer ist Anthropic: Das Imperium der Aussteiger im Wert von 380 Milliarden Dollar

Nachdem wir die Werkzeuge behandelt haben, kommen wir schließlich zur Firma hinter Claude. Denn um Anthropics Ursprung zu verstehen, muss man verstehen, warum Claude einen anderen Weg als andere AI eingeschlagen hat.

Im Jahr 2021 war Dario Amodei Forschungs-Vizepräsident bei OpenAI, während seine Schwester Daniela Amodei Vizepräsidentin für Sicherheitsrichtlinien war. Beide befanden sich im Herzen des weltweit angesehensten AI-Labors und hatten Zugang zu den Trainingsdaten und Architekturdesigns der führenden Modelle sowie das wichtigere: ein erstes Verständnis der Risiken dieser Systeme.

Aber sie entschieden sich zu gehen.

Nicht wegen technischer Meinungsverschiedenheiten, sondern wegen ideologischer Konflikte. Die Geschwister Amodei glaubten, dass die AI-Branche damals zu sehr auf Leistung abzielte und die Sicherheit und Erklärbarkeit vernachlässigte. Während alle anderen darum wetteiferten, wessen Modell größer, schneller und stärker ist, stellten sie eine andere Frage: Was wäre, wenn wir zuerst das Sicherheitsproblem lösen, bevor wir nach Fähigkeiten streben?

Im Jahr 2021 gründeten Dario und Daniela mit 7 Kernforschern von OpenAI Anthropic.

Constitutional AI: Geben Sie der AI eine Verfassung

Die Kernphilosophie von Anthropic lässt sich mit einem Wort zusammenfassen: Constitutional AI (verfassungsmäßige AI).

Im Dezember 2022 veröffentlichte Anthropic eine Forschungsarbeit, die eine neuartige AI-Trainingsmethode vorschlug. Der traditionelle Ansatz besteht darin, eine große Anzahl von menschlichen Annotatoren zu bitten, dem Modell zu sagen, „welche Antworten gut sind und welche schlecht sind“, ein Verfahren, das RLHF (Reinforcement Learning with Human Feedback) genannt wird. Das Problem dabei ist, dass die Bewertungsstandards der menschlichen Annotatoren inkonsistent sind und die Skalierung extrem teuer ist.

Der Ansatz von Anthropic ist anders. Sie geben dem Modell eine „Verfassung“, eine Reihe von Prinzipien, die in natürlicher Sprache verfasst sind und Sicherheit, Ethik, Compliance und andere Aspekte abdecken. Dann lässt man das Modell seine Antworten selbst evaluieren, ob sie diesen Prinzipien entsprechen, und sich entsprechend anpassen.

Einfach gesagt, es ist so, als würde man nicht 100 Tutoren bitten, einen Schüler zu überwachen, sondern dem Schüler ein Regelwerk geben, damit er selbst beurteilen kann, welches Verhalten richtig ist.

Im Januar 2026 veröffentlichte Anthropic die neue Verfassung von Claude. Diese Verfassung ordnete die Verhaltensprioritäten von Claude klar: Sicherheit > Ethik > Compliance > Nützlichkeit für den Nutzer. Mit anderen Worten, selbst wenn der Nutzer von Claude verlangt, etwas zu tun, und es nicht sicher ist, wird Claude ablehnen.

Diese Designphilosophie verschaffte Claude eine einzigartige Position auf dem Markt: Er ist nicht die hörigsten AI, aber wahrscheinlich die vertrauenswürdigste AI.

Finanzierung und Zahlen

Aus der Perspektive des Kapitals hat der Markt offensichtlich zugestimmt.

Die Finanzierungsgeschichte von Anthropic könnte fast als Lehrbuch für Risikokapital betrachtet werden. Im Mai 2023 sammelte sie in der Runde C 450 Millionen Dollar. Im September 2023 kündigte Amazon an, bis zu 4 Milliarden Dollar zu investieren (später auf 8 Milliarden Dollar erhöht). Im Oktober 2023 führte Google 2 Milliarden Dollar an. Im Jahr 2024 führte eine Finanzierungsrunde nach der anderen zu einer Explosion der Bewertung. Bis Februar 2026 schloss Anthropic eine Series-G-Finanzierungsrunde über 30 Milliarden Dollar ab, angeführt von Coatue und dem Singapore Sovereign Fund GIC, mit einer Bewertung von 380 Milliarden Dollar.

Dies ist die zweitgrößte private Finanzierung aller Zeiten, nur übertroffen von OpenAIs über 40 Milliarden Dollar.

Die Liste der Investoren klingt wie eine Machtkarte der Technologiebranche: Amazon, Google, Microsoft, Nvidia, D.E. Shaw, Founders Fund, ICONIQ. Es ist erwähnenswert, dass Microsoft sowohl in OpenAI als auch in Anthropic investiert hat: Das ist kein Widerspruch, sondern eine Absicherung.

Bis März 2026 hat Anthropic einen jährlichen Umsatz von über 14 Milliarden Dollar erreicht (einige Schätzungen glauben, dass es fast 19 Milliarden Dollar erreicht hat). Die Anzahl der Unternehmenskunden, die jährlich mehr als 100.000 Dollar ausgeben, ist im letzten Jahr um das 7-fache gestiegen, und über 500 Kunden geben jährlich mehr als 1 Million Dollar aus.

Die sieben Forscher, die vor fünf Jahren aus OpenAI ausstiegen, haben ein Imperium aufgebaut.

Sicherheit ist kein Hindernis, sondern eine Verteidigungslinie

Rückblickend auf die Situation im Jahr 2021, als Dario Amodei mit 7 Personen OpenAI verließ, glaubte kaum jemand, dass „AI-Sicherheit“ ein Geschäftsfeld werden könnte. Die Mainstream-Narrative damals lautete: Geschwindigkeit ist alles; je größer das Modell, desto besser; zuerst rauskommen und dann sehen.

Fünf Jahre später beträgt die Bewertung von Anthropic 380 Milliarden Dollar.

Hinter dieser Zahl steht eine gegenintuitive Geschäftslogik: Im AI-Bereich ist Sicherheit keine Kostenstelle, sondern die Grundlage für Vertrauen. Und Vertrauen ist der Hauptgrund, warum Unternehmenskunden bereit sind zu zahlen.

Im Jahr 2022 fragten alle, was AI tun kann. Im Jahr 2026 beginnen immer mehr Menschen zu fragen: „Kann AI vertrauenswürdig sein?“…

Anthropic Aktuelle Nachrichten Zusammenfassung

。2026/3/27

Anthropic neues Modell „Claude Mythos“ enthüllt, das als das stärkste in der Geschichte gilt, die Cyberangriffsfähigkeiten beunruhigen sogar die eigenen Angestellten.

。2026/3/26

Anthropic AI Wirtschaftsinformationsbericht: Die Häufigkeit automatisierter Handels-Workflows hat sich verdoppelt, Claude wird von einem Werkzeug zu einem Lebensassistenten.

。2026/3/24

Anthropic führt neue Funktionen zur Computersteuerung + Fernaufgaben über Mobiltelefone ein: Claude kann jetzt direkt Ihren Mac steuern.

。2026/3/22

Anthropic gibt Finanzanalyse-Plugins als Open Source frei: 41 Skills zur ein-Klick-Forschung zu Aktien, Finanzberichterstattung, Vermögensverwaltung…

。2026/3/20

Claude Code führt Kanäle ein: Kann in Telegram, Discord und mit AI-Agenten kommunizieren, Anthropic tritt in direkten Wettbewerb mit openclaw Lobster.