分享币圈内容,享内容挖矿收益

placeholder

gk

d.j

创建人@jayhenry

上市进度

0.00%

市值:

$0.1

更多代币

大饼二饼,高胜率指标战法儿

- 赞赏

- 点赞

- 评论

- 转发

- 分享

$NU

NU Holdings 创下每股18.98美元的历史新高,目前正面临从之前的历史高点回调22%。我关注的两个区域:

1. 需求区间为每股13.45美元至13.76美元。若得到正确确认,我将会进行战略性买入。

2. 若未能守住第一点的区域,那么另一个关键区域是每股12.24美元,这也是一个不错的买入区域。

#NFA

查看原文NU Holdings 创下每股18.98美元的历史新高,目前正面临从之前的历史高点回调22%。我关注的两个区域:

1. 需求区间为每股13.45美元至13.76美元。若得到正确确认,我将会进行战略性买入。

2. 若未能守住第一点的区域,那么另一个关键区域是每股12.24美元,这也是一个不错的买入区域。

#NFA

- 赞赏

- 1

- 评论

- 转发

- 分享

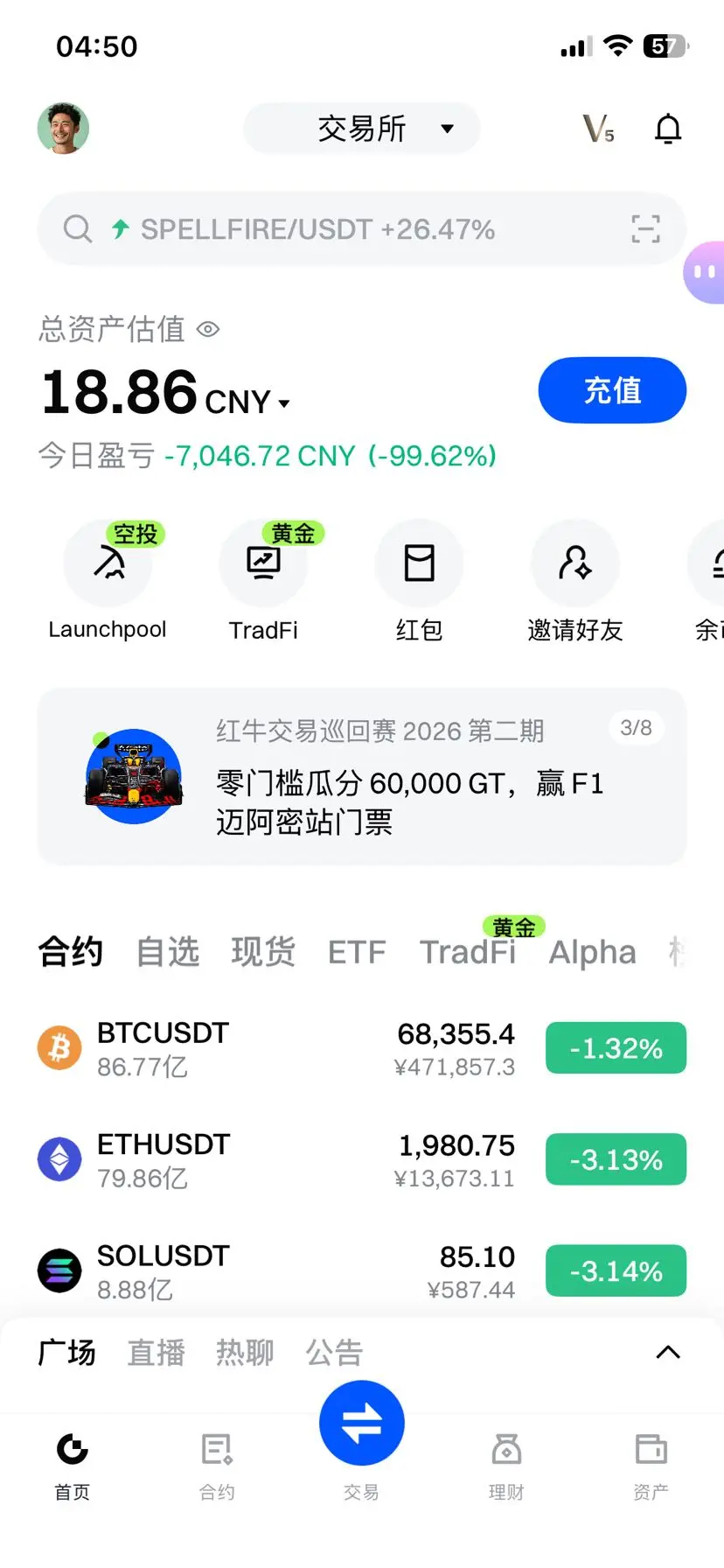

当前现货价:1979.83 USDT;24h -3.07%。

15 分钟级别

支撑/阻力:支撑 ~1958.36,阻力 ~1998.31。

指标:RSI6 ≈58,KDJ J 高(71)显示短线存在回调压力;MACD HIST 负值但趋于回升。

盘口/资金流:15m 总净流入偏正(总买比 ~54%),短时多头主动买盘存在。

1 小时级别

支撑/阻力:支撑 ~1954.4,阻力 ~1994.0。

指标:RSI6 ≈53,MACD DIF 负但 MACD HIST 小幅正(近期多空分歧);EMA 系列接近,未形成明显单边趋势。

资金流:1h 大单净流出明显(large_order_net_flow -351.9),24h 净流出约 -4167 ETH,显示大户在更高时间框架上偏减仓或观望。

15 分钟级别

支撑/阻力:支撑 ~1958.36,阻力 ~1998.31。

指标:RSI6 ≈58,KDJ J 高(71)显示短线存在回调压力;MACD HIST 负值但趋于回升。

盘口/资金流:15m 总净流入偏正(总买比 ~54%),短时多头主动买盘存在。

1 小时级别

支撑/阻力:支撑 ~1954.4,阻力 ~1994.0。

指标:RSI6 ≈53,MACD DIF 负但 MACD HIST 小幅正(近期多空分歧);EMA 系列接近,未形成明显单边趋势。

资金流:1h 大单净流出明显(large_order_net_flow -351.9),24h 净流出约 -4167 ETH,显示大户在更高时间框架上偏减仓或观望。

ETH-3.47%

- 赞赏

- 2

- 评论

- 转发

- 分享

🚀📊💰🔍🧠🌊🏦📈🔄💎🔥

“加密货币市场是唯一一个你可以在一天之内成为天才、亿万富翁,然后再次成为天才的地方……因为你坚持了下来。”😄 2024–2026年,加密货币市场已超越了比特币和快速资本增长梦想是唯一主题的阶段。这个市场已发展成为一个结构化的生态系统,市值在高峰时期达到2到3万亿美元。在这种环境下,每个行业都具有独特的经济模型、风险特征和流动性动态。行业分析变得尤为重要,因为资金流动呈波浪式:从Layer 1平台到人工智能,从memecoin到真实世界资产的代币化(RWA)。

曾经,只需购买比特币并等待下一次减半周期。然而今天,盈利来自新兴技术、趋势叙事和流动性分布的交汇点。值得注意的是,80%的总利润通常集中在20%处于积极扩张阶段的行业。市场增长的主要驱动力是资金轮动。当比特币的主导地位超过50%到55%时,山寨币通常会失去动力。这一指标的下降常常标志着行业季节的开始,此时深入分析和战略规划成为投资成功的关键因素。

Layer 1和Layer 2解决方案仍然是整个市场的基础。DeFi中的总锁仓价值(TVL)在高峰期已超过$100 十亿,显著部分集中在以太坊、Solana和正在发展的模块化区块链生态系统中。Layer 2解决方案将交易成本降低至5到20倍,并将吞吐量提升至每秒数千笔交易,实现了在不牺牲安全性的情况下的可扩展性。资金积极流入低交易成本的

查看原文“加密货币市场是唯一一个你可以在一天之内成为天才、亿万富翁,然后再次成为天才的地方……因为你坚持了下来。”😄 2024–2026年,加密货币市场已超越了比特币和快速资本增长梦想是唯一主题的阶段。这个市场已发展成为一个结构化的生态系统,市值在高峰时期达到2到3万亿美元。在这种环境下,每个行业都具有独特的经济模型、风险特征和流动性动态。行业分析变得尤为重要,因为资金流动呈波浪式:从Layer 1平台到人工智能,从memecoin到真实世界资产的代币化(RWA)。

曾经,只需购买比特币并等待下一次减半周期。然而今天,盈利来自新兴技术、趋势叙事和流动性分布的交汇点。值得注意的是,80%的总利润通常集中在20%处于积极扩张阶段的行业。市场增长的主要驱动力是资金轮动。当比特币的主导地位超过50%到55%时,山寨币通常会失去动力。这一指标的下降常常标志着行业季节的开始,此时深入分析和战略规划成为投资成功的关键因素。

Layer 1和Layer 2解决方案仍然是整个市场的基础。DeFi中的总锁仓价值(TVL)在高峰期已超过$100 十亿,显著部分集中在以太坊、Solana和正在发展的模块化区块链生态系统中。Layer 2解决方案将交易成本降低至5到20倍,并将吞吐量提升至每秒数千笔交易,实现了在不牺牲安全性的情况下的可扩展性。资金积极流入低交易成本的

- 赞赏

- 1

- 评论

- 转发

- 分享

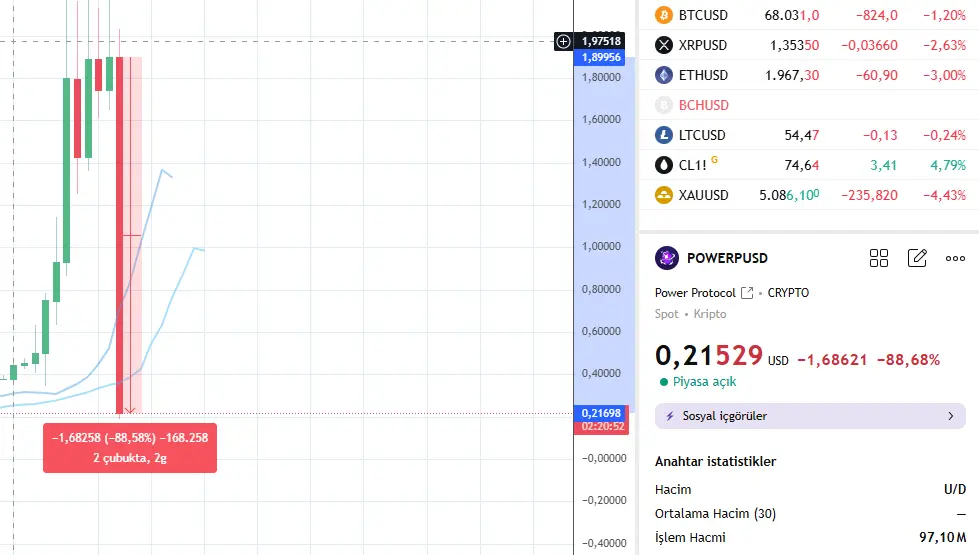

#DeepCreationCamp 比特币目前正处于一个高度反应性的结构中,随着整个加密市场波动性的回归。在本季度早期的强劲冲动上涨之后,BTC进入了盘整阶段,在日线图上形成了一个收紧的区间。价格走势显示出在关键支撑和阻力位之间的压缩,暗示突破行情可能即将到来。

在技术面上,BTC仍然高于其100日和200日移动平均线,表明整体趋势仍然看涨。然而,相对强弱指数(RSI)徘徊在中性50区域附近,反映出买卖双方的犹豫不决。在盘整期间,成交量略有下降,这通常预示着即将出现扩张。突破时成交量的激增将确认下一步的方向。

从结构角度来看,周线图上的高点仍然保持完好,维持看涨的市场结构。近期的摆动高点附近设有立即阻力位。确认日线收盘高于该水平可能引发动能,推动价格向下一个心理阻力区前进。在下行方面,强劲的需求仍然集中在之前的突破区域附近,该区域现已成为支撑位。若价格跌破该区域,将转为短期看空情绪,并为更深的回撤打开空间。

宏观情绪也起到一定作用。机构对比特币ETF的兴趣以及更广泛的采用持续支持长期信心。然而,短期价格变动仍然对全球流动性状况和传统市场的风险偏好敏感。$BTC

在技术面上,BTC仍然高于其100日和200日移动平均线,表明整体趋势仍然看涨。然而,相对强弱指数(RSI)徘徊在中性50区域附近,反映出买卖双方的犹豫不决。在盘整期间,成交量略有下降,这通常预示着即将出现扩张。突破时成交量的激增将确认下一步的方向。

从结构角度来看,周线图上的高点仍然保持完好,维持看涨的市场结构。近期的摆动高点附近设有立即阻力位。确认日线收盘高于该水平可能引发动能,推动价格向下一个心理阻力区前进。在下行方面,强劲的需求仍然集中在之前的突破区域附近,该区域现已成为支撑位。若价格跌破该区域,将转为短期看空情绪,并为更深的回撤打开空间。

宏观情绪也起到一定作用。机构对比特币ETF的兴趣以及更广泛的采用持续支持长期信心。然而,短期价格变动仍然对全球流动性状况和传统市场的风险偏好敏感。$BTC

BTC-1.48%

- 赞赏

- 3

- 评论

- 转发

- 分享

oi oi

oi

创建人@GateUser-15f6d0de

认购进度

0.00%

市值:

$0

更多代币

- 赞赏

- 2

- 评论

- 转发

- 分享

🐋 巨鲸观察:战争最新动态

=> 11枚弹道导弹。

=> 123架无人机。

=> 一天时间。

阿联酋的防空系统刚刚经受了一次重大考验。虽然一枚导弹击中,但没有人员伤亡,这完全是现代技术和准备的奇迹。

保持安全,阿联酋。 #CryptoMarketBouncesBack

查看原文=> 11枚弹道导弹。

=> 123架无人机。

=> 一天时间。

阿联酋的防空系统刚刚经受了一次重大考验。虽然一枚导弹击中,但没有人员伤亡,这完全是现代技术和准备的奇迹。

保持安全,阿联酋。 #CryptoMarketBouncesBack

- 赞赏

- 2

- 1

- 转发

- 分享

ybaser :

:

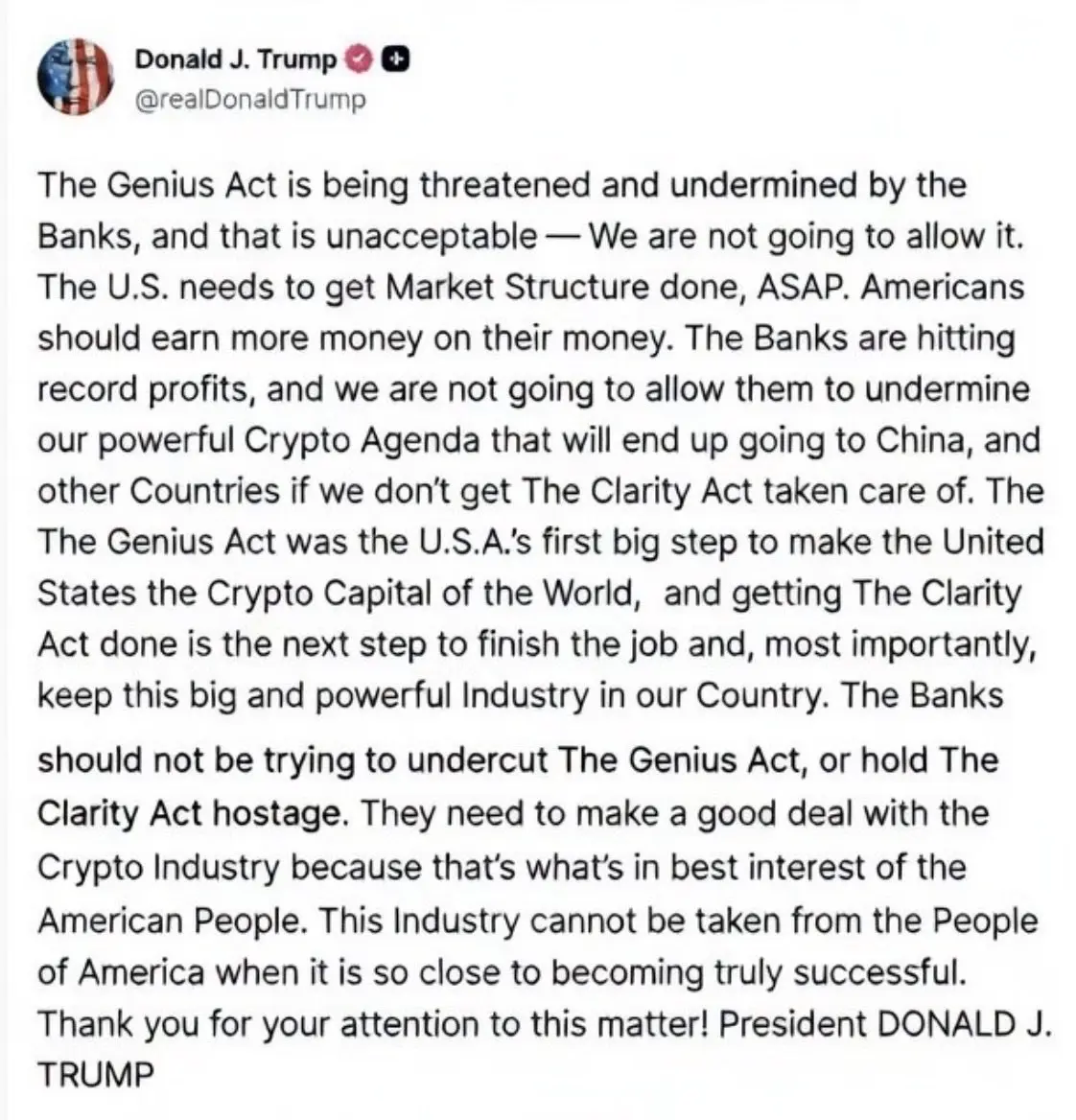

直达月球 🌕集体决策

去中心化的稳定币绝不应在幕后被控制。

通过JST投票机制,社区共同积极管理协议。

每个提案都是透明的。

每一票都是公开的。

每个JST持有者都有发言权。

这确保了USDD作为由人民打造、为人民治理的稳定币。

去中心化的稳定币绝不应在幕后被控制。

通过JST投票机制,社区共同积极管理协议。

每个提案都是透明的。

每一票都是公开的。

每个JST持有者都有发言权。

这确保了USDD作为由人民打造、为人民治理的稳定币。

查看原文

- 赞赏

- 3

- 评论

- 转发

- 分享

我曾经相信人工智能。然后它以百分之百的信心告诉我一个基本事实是错误的。

这才是问题所在。AI不会结巴。它不会说“也许”。即使在编造事情时,它听起来也很确定。

现在想象一下,“确定但错误”的AI在管理资金、撰写法律文件、运行机器人。令人毛骨悚然,对吧?

#mira $MIRA @Mira - AI的信任层 #Mira

我们需要一种方法来检查AI的工作。不是相信一个模型,而是跨多个模型进行验证。

这就是为什么我关注像Mira这样的项目。他们正在构建一个验证层。可以把它看作是AI输出的事实核查员。

我们让机器创造,然后让网络验证。如果我们要让AI触及真正的资金和决策,我们就需要凭证。

信任是赢得的,而不是生成的。

这才是问题所在。AI不会结巴。它不会说“也许”。即使在编造事情时,它听起来也很确定。

现在想象一下,“确定但错误”的AI在管理资金、撰写法律文件、运行机器人。令人毛骨悚然,对吧?

#mira $MIRA @Mira - AI的信任层 #Mira

我们需要一种方法来检查AI的工作。不是相信一个模型,而是跨多个模型进行验证。

这就是为什么我关注像Mira这样的项目。他们正在构建一个验证层。可以把它看作是AI输出的事实核查员。

我们让机器创造,然后让网络验证。如果我们要让AI触及真正的资金和决策,我们就需要凭证。

信任是赢得的,而不是生成的。

MIRA-6.07%

- 赞赏

- 1

- 评论

- 转发

- 分享

加载更多

加入 4000万 人汇聚的头部社区

⚡️ 与 4000万 人一起参与加密货币热潮讨论

💬 与喜爱的头部博主互动

👍 查看感兴趣的内容

热门 Gate Fun

查看更多- 市值:$2372.41持有人数:10.00%

- 市值:$2404.63持有人数:20.00%

- 市值:$0.1持有人数:10.00%

- 市值:$0.1持有人数:10.00%

- 市值:$0.1持有人数:10.00%

快讯

查看更多置顶

🧧 Gate 广场 $50,000 红包雨狂撒,发帖 100% 中奖!

活动全面加码,奖励上不封顶!

🚀 人人有份: 新老用户发帖即领,单帖最高可得 28U!

📈 多发多得: 参与次数不设限,发帖越多,红包拿得越手软!

立即参与:

1️⃣ 更新 App: 升级至 v8.8.0 版本。

2️⃣ 开启红包: 点击发帖,奖励自动入账!

马上发帖领红包 👉 https://www.gate.com/post

详情: https://www.gate.com/announcements/article/49773Gate 广场|3/2 今日话题: #贵金原油价格飙升

🎁 带话题发帖,抽 5 位锦鲤送出 $2,500 仓位体验券!

中东局势突变!美以联手空袭,伊朗反击并封锁霍尔木兹海峡。航运受阻引发原油跳涨,避险情绪驱使资金疯狂涌入黄金,贵金属飙升。动荡之下,财富机会何在?

💬 本期热议:

1️⃣ 原油、贵金属还能涨多远?关键点位在哪?

2️⃣ 这波你在 Gate TradFi 布局了吗?欢迎晒收益。

3️⃣ 美伊后续怎么走?会如何影响原油、金属和加密市场?

分享观点,瓜分好礼 👉️ https://www.gate.com/post

Gate TradFi 👉️ https://www.gate.com/tradfi

📅 3/2 15:00 - 3/4 12:00 (UTC+8)