Theta EdgeCloudはどのように動作するのでしょうか。AIエッジコンピューティングの全体的なワークフローについて、詳しくご説明します。

従来のAIクラウドサービスは、大規模な集中型データセンターに依存するのが一般的です。この構成は高い計算能力を提供しますが、GPUコストの増大やリソース管理の集中化、スケーラビリティの課題を招きます。Theta EdgeCloudは、エッジノードとクラウドコンピューティングを組み合わせ、世界中の遊休GPUリソースを一つのネットワークに集約することで、リソース利用率と分散型コラボレーションの向上を目指しています。

AIインフラ市場の競争が激しくなる中、Theta EdgeCloudはDePIN(分散型物理インフラネットワーク)および分散型GPUネットワークの先進例として存在感を放っています。従来型クラウドプラットフォームの完全な代替を目指すのではなく、AI推論やエッジコンピューティング環境における柔軟なリソース連携の実現が主な目的です。

Theta EdgeCloudとは

Theta EdgeCloudは、Theta Networkエコシステム上に構築されたハイブリッドAIクラウドプラットフォームです。その特徴は、分散型Edge Nodeと従来型クラウドGPUサービスを組み合わせて、統合された計算資源ネットワークを形成する点にあります。

従来の中央集権型AIクラウドサービスとは異なり、Theta EdgeCloudはクラウドサーバーのみならず、世界中のユーザーが運用するEdge Nodeからもリソースを調達します。これらのノードが遊休GPU・CPU・帯域幅を共有し、AI推論やビデオトランスコーディング、レンダリング処理を実現します。

開発者にとって、Theta EdgeCloudは分散リソースを動的に制御するAIコンピュートレイヤーとして機能します。開発者はプラットフォーム経由でタスクを提出するだけで、システムが自動的にリソース割り当てと実行を担うため、ノード管理の手間が不要です。

Theta EdgeCloudと従来AIクラウドサービスの違い

従来のAIクラウドプラットフォームは、主に大規模データセンターが集中してGPUサービスを提供し、クラウドプロバイダーがリソースの管理・スケジューリングを行います。この方式は安定・成熟していますが、GPU不足やコスト増のリスクを抱えます。

一方でTheta EdgeCloudは、「エッジリソース共有」を重視しています。世界各地のEdge Nodeが遊休GPUリソースを提供し、AIタスクが提出されると、プラットフォームがタスク内容・ノード状況・計算力に応じてリソースの割り当てを行います。

Theta EdgeCloudと従来AIクラウドプラットフォームの主な相違点は以下の通りです:

| 比較項目 | 従来AIクラウドプラットフォーム | Theta EdgeCloud |

|---|---|---|

| リソース供給源 | 集中型データセンター | クラウドGPU+Edge Node |

| ネットワーク構造 | 中央集権型 | 分散型 |

| GPUスケジューリング | 集中管理型プラットフォーム | 動的ノード連携 |

| ノード参加者 | クラウドサービスプロバイダー | ユーザー共有リソース |

| インセンティブ | サービス料金 | TFUEL報酬メカニズム |

このような仕組みにより、Theta EdgeCloudは従来型クラウドではなく、真の分散型GPUネットワークとして位置付けられます。

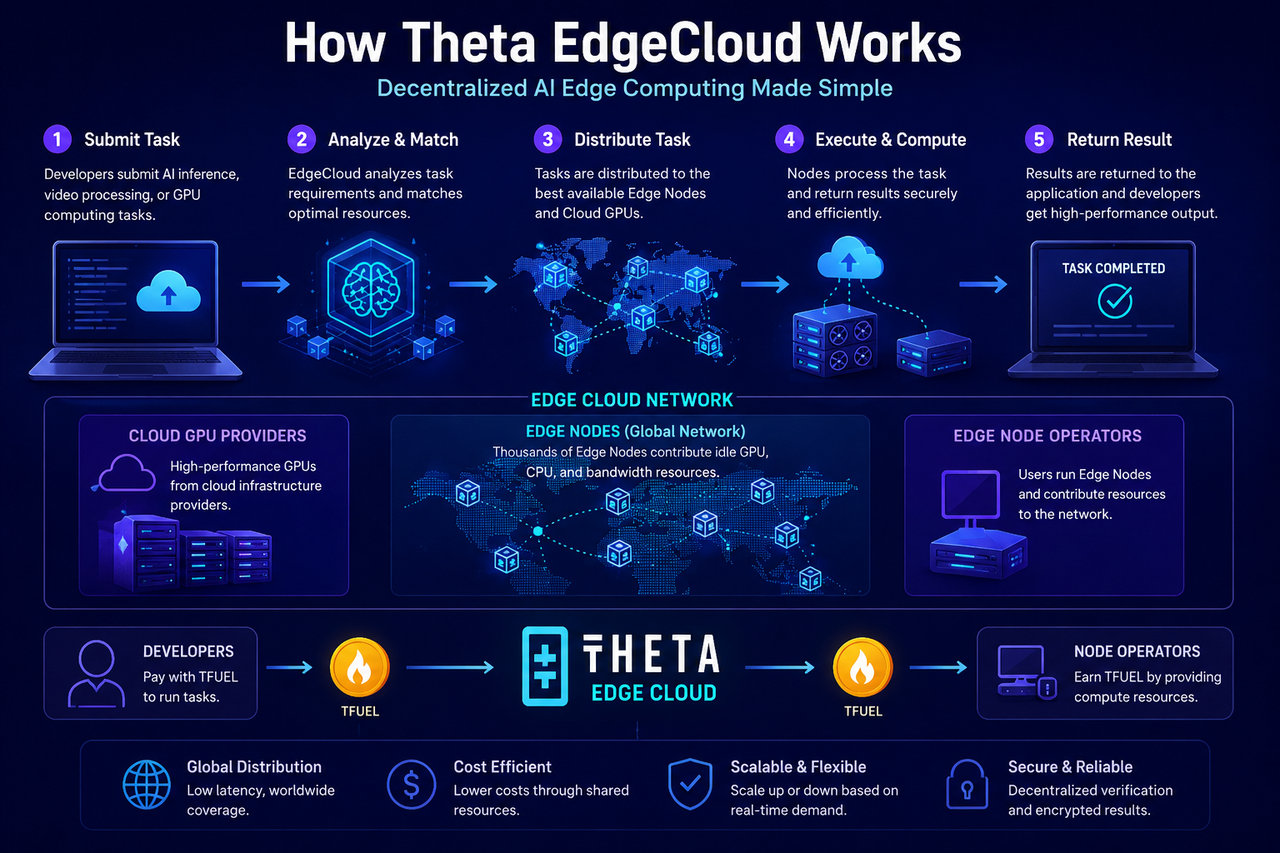

ユーザーがAIタスクを提出した際の流れ

開発者やアプリがAI推論・ビデオ処理・レンダリングタスクを提出すると、Theta EdgeCloudはまずGPU種別やメモリ、計算時間、帯域幅などのリソース要件を解析します。

システムはネットワーク全体から適切なノードリソースを特定します。タスクによってはクラウドGPUが処理を担当し、他は世界中のEdge Nodeに分散して協調実行されます。すべての流れが自動化されており、開発者によるノード選択は不要です。

タスク実行中は、システムがノード状態とタスク進行状況を常時監視します。ノードがオフラインになる、またはリソースが不足した場合は、プラットフォームが自動で再割り当てし、計算の安定性を維持します。

実行完了後、結果はアプリ層へ返され、参加ノードには貢献したリソース量に応じてTFUEL報酬が支払われます。

この仕組みは、ネットワーク全体の遊休計算力を一元活用する「分散型リソーススケジューリングシステム」といえます。

Edge NodeによるGPU計算への貢献

Edge NodeはTheta EdgeCloudの中核コンポーネントです。Edge Nodeを稼働させることで、ユーザーは自身のGPUや計算リソースをThetaネットワークに接続できます。

ネットワークがAI推論・ビデオレンダリング・エッジコンピューティングの需要を検知すると、これらのノードへタスクが割り当てられます。完了後、ノードは提供した計算リソース量に応じてTFUEL報酬を受け取ります。

従来のマイニングマシンとは異なり、Theta Edge NodeはPoWマイニングではなく実際の計算リソースの提供を目的としています。これがThetaがDePINプロジェクトとされる主な理由です。

多くのユーザーにとってEdge Nodeは、Thetaネットワーク参加の入口であり、リソース共有の基盤です。

EdgeCloudにおけるTFUELの循環

TFUELはTheta EdgeCloudの主要ユーティリティトークンであり、ネットワーク内での支払手段やインセンティブとして機能します。

開発者がAIやビデオタスクを提出する際、TFUELでリソース料金を支払います。システムは、そのタスクの実行に貢献したEdge NodeへTFUELの一部を分配します。

EdgeCloudエコシステムでは、TFUELが以下の関係をつなぎます:

-

AIアプリ開発者

-

GPUリソースプロバイダー

-

Edge Nodeネットワーク

-

Thetaインフラストラクチャ

これにより、「タスク支払い→リソース実行→ノード報酬」というサイクルが構築されます。

Theta EdgeCloudの主要活用シーン

Theta EdgeCloudは主にAI・メディアコンピューティング用途に特化しています。

AI分野の活用例:

-

AIモデル推論

-

大規模言語モデル推論

-

画像生成

-

分散型GPUコンピューティング

ビデオ・メディア分野では:

-

ビデオトランスコーディング

-

ビデオレンダリング

-

ライブストリーミング処理

-

エッジコンテンツ配信

エッジノードが世界中に分散しているため、リアルタイム性が必要なタスクはエッジコンピューティングによって遅延を最小限に抑えられます。

AIとWeb3インフラの融合が進む中、Theta EdgeCloudはThetaのビデオエコシステムからAI領域への拡大を牽引しています。

Theta EdgeCloudが直面する課題

分散型GPUネットワークはリソース共有や拡張性を提供しますが、Theta EdgeCloudにも現実的な課題があります。

まず、すべてのエッジノードでハードウェア性能が均一ではなく、GPU性能の違いがタスク効率に影響します。また、分散型ネットワークゆえにリソーススケジューリングやタスク管理の複雑性が増します。

さらに、AIインフラ市場の競争が加速し、従来クラウドや他の分散型GPUネットワークともシェア争いが激化しています。

加えて、生成AIによる高性能GPU需要の増加から、EdgeCloudでは安定したGPUリソース確保とスケジューリングが長期的な課題となっています。

まとめ

Theta NetworkがローンチしたTheta EdgeCloudは、分散型AI・エッジコンピューティングプラットフォームとして、世界中のEdge NodeとクラウドGPUを統合し、分散型AI計算ネットワークの構築を目指しています。

従来の中央集権型AIクラウドサービスに比べ、Theta EdgeCloudはエッジリソース共有・GPU協業・分散スケジューリングを重視。開発者はプラットフォームでAI推論やビデオ処理タスクを提出し、グローバルなノードがそれを実行してTFUEL報酬を獲得します。

AI推論やGPUリソース需要が増大する中で、Theta EdgeCloudはThetaをビデオストリーミングプラットフォームから包括的なAIインフラへと進化させています。

よくある質問

Theta EdgeCloudはどのように動作しますか?

開発者がAIまたはビデオタスクを提出すると、システムは自動的にクラウドGPUとEdge Nodeへタスクを割り当て、協調処理を行います。TFUELがリソースの支払とノード報酬に使われます。

Edge NodeはEdgeCloudでどんな役割を果たしますか?

Edge NodeはGPU・計算リソースを提供し、AI推論やビデオレンダリング、エッジコンピューティングタスクを実行します。

Theta EdgeCloudは従来AIクラウドサービスとどう違いますか?

従来AIクラウドサービスは中央集権型データセンターに依存しますが、Theta EdgeCloudはエッジノードとクラウドGPUを組み合わせた分散型リソースネットワークです。

EdgeCloudでのTFUELの用途は?

TFUELはAI・ビデオタスクの手数料支払いと、タスク完了時のノード報酬トークンとして利用されます。

Theta EdgeCloudはDePINプロジェクトですか?

GPU・エッジコンピューティングリソースの共有をコアモデルとするため、Theta EdgeCloudはDePINおよび分散型GPUネットワークプロジェクトと見なされています。

関連記事

ONDOトークン経済モデル:プラットフォームの成長とユーザーエンゲージメントをどのように推進するのか

Render、io.net、Akash:DePINハッシュレートネットワークの比較分析

AI分野におけるRenderの申請理由:分散型ハッシュレートが人工知能の発展を支える仕組み

Plasma(XPL)トークノミクス分析:供給、分配、価値捕捉

SentioとThe Graph:リアルタイムインデックス機構とサブグラフインデックス機構の比較